Józan ész alapú univerzális AI ügynök

( 2026 március)

Abstract: Operating Principle and Architecture: The agent is not generative (it does not predict pixels) but rather representational: it models the essential state variables (latent variables) of the environment. It condenses input data (text, images, sensor data) into an abstract latent space, filtering out noise,

It learns temporal and logical continuity through masked self-supervised learning (e.g., hiding video segments). It refines the model’s predictive capabilities using stochastic approximation. The system updates the current state using variational Bayesian inference (or hierarchical state space models), ensuring robustness to noise.

Active Inference module: when making decisions, the agent selects actions that minimize the expected prediction error (learning) and maximize the objective function (action). Before making a decision, the agent runs through possible scenarios via internal simulation, allowing it to select among outputs without risk. Due to its hierarchical latent representation, it has low resource requirements and can run on small-scale hardware.

The new type of agent is fault-tolerant, with a target decision reliability of at least 98%. It is expected that the remaining error will be white noise-like (uncorrelated and with a zero expected value), rather than systematic bias. Due to masked unsupervised learning, it requires orders of magnitude less human intervention than traditional reinforcement learning.

It learns temporal and logical continuity through masked self-supervised learning (e.g., hiding video segments). It refines the model’s predictive capabilities using stochastic approximation. The system updates the current state using variational Bayesian inference (or hierarchical state space models), ensuring robustness to noise.

Active Inference module: when making decisions, the agent selects actions that minimize the expected prediction error (learning) and maximize the objective function (action). Before making a decision, the agent runs through possible scenarios via internal simulation, allowing it to select among outputs without risk. Due to its hierarchical latent representation, it has low resource requirements and can run on small-scale hardware.

The new type of agent is fault-tolerant, with a target decision reliability of at least 98%. It is expected that the remaining error will be white noise-like (uncorrelated and with a zero expected value), rather than systematic bias. Due to masked unsupervised learning, it requires orders of magnitude less human intervention than traditional reinforcement learning.

Összefoglalás: Yann LeCun JEPA modelljét önfelügyelt maszkos tanulással videókkal tanítja a fizikai törvények felismerésére, ami elvi szinten különbözik a szavakkal, megerősítéssel tanított LLM-től.

LeCun világmodelljéből fejlesztettük ki a Józan ész alapú univerzális MCS-Agent, új ügynököt, ami már egy erős asztali gépen is futtatható, felhő nélkül. Azért Józan ügynök, mert a valószínű (Bayes) döntéseket használja. A Bayesi megközelítésbe „beépített” egyszerűség miatt hívják a döntést Bayesi borotvá-nak is, a döntés az adatok és a korábbi tapasztalatok súlyozása adja. Az ügynök a szövegek, képek, hangok, videók információját önfelügyelő tanulással, maszkolással sajátítja el. Lényeges újdonság a szó bemetről a videó bemenetre történő áttérés.

A Józan ügynök szimulációval jósolja a jelenségek várható működését: a predikciós hibáiból tanul, a hiba a feltételezés szerint korrelálatlan az előrejelzésekkel, így zérus várható értékű is. Az univerzális ügynökök működésénél feltételezzük a lehetséges hibás működést, a 98%-os predikciós megengedett hibahatár reális követelmény valószínűségi következtetéseknél. A 98%-os határ idővel 99% fölé fog nőni. (Vannak területek, pl. pénzügy, ahol nem megengedhető, ahová biztonsági modul hívása szükséges.) A koncepció technikai részletei kidolgozásra várnak, pl. a változtatható, itt 98%-os állagos pontosság-paraméter függ a hardver megengedett méretétől is.

Yann LeCun JEPA (Joint Embedding Predictive Architecture) modellje 2026 márciusában az AMI Labs (Advanced Machine Intelligence) alapkövévé vált. A technológia legfrissebb állapota szerint a hangsúly a nyelvi modellekről (LLM) a fizikai világot értő "világmodellekre" helyeződött át.

A legfrissebb fejlesztések (2026. március)

Videós JEPA 2.1: a Meta kutatói által március közepén közzétett modell már nemcsak a videók globális dinamikáját érti, hanem a finom, helyi térbeli részleteket is, ami áttörést jelent a robotikai navigációban és a tárgyakkal való interakciók előrejelzésében.

LeWorldModel (LeWM) egy egyszerűsített architektúrát, amely képes tanulni közvetlenül nyers pixelekből, különösebb mérnöki trükkök nélkül. A modell akár 48-szor gyorsabb tervezésre képes, mint a hagyományos alapmodellek, és akár egyetlen GPU-n is betanítható.

VL-JEPA (Vision-Language): 2026 elején debütált ez a változat, amely a szöveget nem szavanként generálja, hanem folytonos beágyazásként (embedding) jósolja meg. Emiatt közel 3-szor gyorsabb a dekódolása, mint a hagyományos modelleké.

Főbb jellemzők és különbségek az LLM-ekhez képest:

A legfrissebb fejlesztések (2026. március)

Videós JEPA 2.1: a Meta kutatói által március közepén közzétett modell már nemcsak a videók globális dinamikáját érti, hanem a finom, helyi térbeli részleteket is, ami áttörést jelent a robotikai navigációban és a tárgyakkal való interakciók előrejelzésében.

LeWorldModel (LeWM) egy egyszerűsített architektúrát, amely képes tanulni közvetlenül nyers pixelekből, különösebb mérnöki trükkök nélkül. A modell akár 48-szor gyorsabb tervezésre képes, mint a hagyományos alapmodellek, és akár egyetlen GPU-n is betanítható.

VL-JEPA (Vision-Language): 2026 elején debütált ez a változat, amely a szöveget nem szavanként generálja, hanem folytonos beágyazásként (embedding) jósolja meg. Emiatt közel 3-szor gyorsabb a dekódolása, mint a hagyományos modelleké.

Főbb jellemzők és különbségek az LLM-ekhez képest:

Jellemző Hagyományos LLM / Generatív AI JEPA / Világmodellek

Működési elv Következő token vagy pixel jóslása Absztrakt reprezentációk jóslása

Cél Szöveggenerálás és csevegés A fizika, az ok-okozat és az idő értése

Hatékonyság Óriási számítási igény a részletek miatt Sokkal gyorsabb tanulás és tervezés (akár 10x-es sebesség)

Yann LeCun, a Meta korábbi vezető mesterséges intelligencia (AI) kutatója megalapította az Advanced Machine Intelligence nevű startupot: 1,03 milliárd dolláros befektetést jelentett be, 3,5 milliárd dolláros vállalatértékeléssel. A cég az úgynevezett világmodell magalkotását, valamint a következtetésre és tervezésre képes AI-rendszerek kereskedelmi hasznosítását tűzte ki célul. A befektetési kört a Cathay Innovation, a Greycroft, a Hiro Capital, a HV Capital és Jeff Bezos befektetési cége, a Bezos Expeditions közösen vezeti.((https://www.wired.com/story/yann-lecun-raises-dollar1-billion-to-build-ai-that-understands-the-physical-world/). https://www.

portfolio.hu/befektetes/20260310/kulonleges-ai-rendszert-epit-az-ismert-ai-guru-startupja-ez-mas-lesz-mint-az-eddigi-modellek-823280) (A Meta időközben átszervezte AI-fejlesztéseit: 2025 júniusában létrehozta a Meta Superintelligence Labs nevű részleget, amelynek élére Alexander Wangot, a Scale AI korábbi vezérigazgatóját nevezte ki.) LeCun világmodellje egy új, önálló kutatási irány, amihez felhasználhatja az LLM modellek eredményeit bemenetként: sikeres új fejlesztés.

A világmodell (JEPA) célkitűzés egyben LeCun meggyőződésének próbája is: a kutató szerint a mai nagy nyelvi modellek önmagukban nem képesek emberi szintű gondolkodásra és önálló döntéshozatalra. Startupja olyan világmodellt épít, amely összetett, valós környezetben képes értelmezésre, következtetésre, előrejelzésre és tervezésre, egy széles körben alkalmazható, intelligens ügynök. A vállalat rövid távon összetett rendszereket üzemeltető cégeket céloz meg ügyfélként: gyártóvállalatokat, autóipari és repülőgépipari cégeket, valamint biomedicinális és gyógyszeripari vállalatokat. Hosszabb távon a technológia fogyasztói alkalmazásokban, pl. robotokban is megjelenhet.

A világmodell alapjait (naiv fizika, ok-okozati összefüggések, valószínűségi állítások) LeCun szerint videókon és szenzoros adatokon keresztül kell betanítani, önfelühyelt tanulással, maszkolással, és nem szövegeken keresztül. A V-JEPA rendszere ötvözi a világmodelleket a szöveges predikcióval. Léteznek olyan kísérleti irányok (pl. LLM-JEPA hibridek), ahol magát az LLM-et próbálják a JEPA-architektúra elvei szerint tanítani, hogy a szöveges információkat mélyebb összefüggésekként (embedding-térben) kezelje. LeCun a világmodellt egy olyan "szimulátorként" képzel el, amely a fizikai jelenségeket modellezi, a rendszer a fizikai tudását nem a nyelvi modellekből, hanem közvetlen megfigyelésekből nyeri. A LeCun féle V-JEPA modellek tanítása videók segítségével a fizikai törvények felismerésére: a V-JEPA (Video Joint Embedding Predictive Architecture) modell a világ fizikai működését kiterjedt videóállományok tanulásával (self-supervised learning) maszkolással sajátítja el. A folyamat lényege, hogy a gép magyarázatokat nem kap, de mintázatokat felismer. Maszkolási stratégia (Masking): A modellnek videórészleteket mutatnak, de a képkockák egy részét (térben és időben egyaránt) kitakarják. A rendszer feladata, hogy kitalálja, mi van a "maszk" alatt. A maszkolt adat alapján jósol, és a nem maszkolt adat összehasonlításával kapja az előrejelzési hibát.

Egy reprezentációs térben (állapottér, latent space) jósolja meg a tárgyak tulajdonságait és mozgását, ami azért fontos, mert a valóság kiszámíthatatlan részleteit figyelmen kívül hagyhatja, és a lényegre (pl. a pohár esése) koncentrál. A tanítás során a modell folyamatosan összeveti a jóslatait a tényleges videókkal. Ha a jóslat hibás (pl. egy elguruló labda a jóslattal ellentétben nem tűnik el a fal mögött, hanem átmegy rajta, azaz a "labda megmaradásának elve"), ellentmondásra jut. Az előrejelzés hibája javítja a világmodell működését, megerősítéssel a helyes válaszoknál. Több ezer órányi videó (pl. YouTube-klipek) megfigyelése után a modell felismeri az objektum állandóságát (tudja, hogy ami kimegy a képből, az még létezik) és a tárgyak dinamikáját. A kutatások szerint a V-JEPA képes 98%-os pontossággal felismerni, ha egy videóban fizikai törvény teljesül vagy nem teljesül (pl. egy tárgy a levegőben marad alátámasztás nélkül a maszkolás miatt), miközben a hagyományos LLM-ek ezen a téren sokszor csak tippelnek. (A Meta AI V-JEPA projektoldalán további technikai részletek olvashatóak.)

Kitérő a megengedett hibákról: Ha abból indulunk ki, hogy az univerzális AI-ügynökök elvileg is hibákkal működhet, akkor a 98%-os hibahatár reális követelmény. Az univerzális ügynök hibái akkor elfogadhatóak, ha a hiba

- nem trendszerű, azaz nem „felfelé” vagy „lefelé” téved az AI következetesen, hanem hol alul, hol felülbecsül. Ha mindig ugyanabba az irányban téved, azt jelenti, hogy valami fontosa megtanulandót figyelmen kívül hagy,

- nem trendszerű, azaz nem „felfelé” vagy „lefelé” téved az AI következetesen, hanem hol alul, hol felülbecsül. Ha mindig ugyanabba az irányban téved, azt jelenti, hogy valami fontosa megtanulandót figyelmen kívül hagy,

- nem kiszámítható, azaz a tévedésekben nincs felismerhető minta, esetleg összefüggés az előrejelzés értékével.

- hatékony, megtanulta az összes információt az adatokból. Ami hibaként megmarad, az a tiszta, értelmezhetetlen véletlen sorozat, amiből már ember vagy gép sem tudna több információt kinyerni.

- hatékony, megtanulta az összes információt az adatokból. Ami hibaként megmarad, az a tiszta, értelmezhetetlen véletlen sorozat, amiből már ember vagy gép sem tudna több információt kinyerni.

Az önálló érzékelés és elemzés során az új MCS-ügynök folyamatosan figyeli a környezetét (legyen az a web, videó, egy vállalati adatbázis vagy fizikai szenzor). Fokozatosan működés közben ismeri meg a környezetét, amihez az adatokat nemcsak tárolja, hanem értelmezi is. A tanulás módja a Self-supervised Learning , az önfelügyelt tanulás, maszkolással. A mai fejlett mesterséges intelligenciák szinte mind erre épülnek: a nyelvi modellek (NLP): a Google BERT vagy a GPT modellek így tanulják meg a nyelv logikáját hatalmas szövegtestekből. Képek felismerése és csoportosítása lehetséges anélkül, hogy minden képre ráírnánk, mi van rajta. Beszédfelismerésnél az emberi beszéd mintázatainak felismerése lehetséges nyers hanganyagokból. A módszer tette lehetővé a generatív MI (mint a ChatGPT) és a JEPA robbanásszerű fejlődését, mivel az interneten elérhető szinte minden szöveges és képi adatot fel tudtak használni a tanításukhoz.

Azért engedjük meg az AI 98%-os hibás működést, mert általában valószínűségi állításokat használunk. Amennyiben az AI hibát követ el az elégtelen bemenő adatok, vagy a gyenge következtetések miatt A 98%-os megengedett hibahatár a hardverméret jelentős csökkenését vonja maga után, már ahol megengedhető hiba.

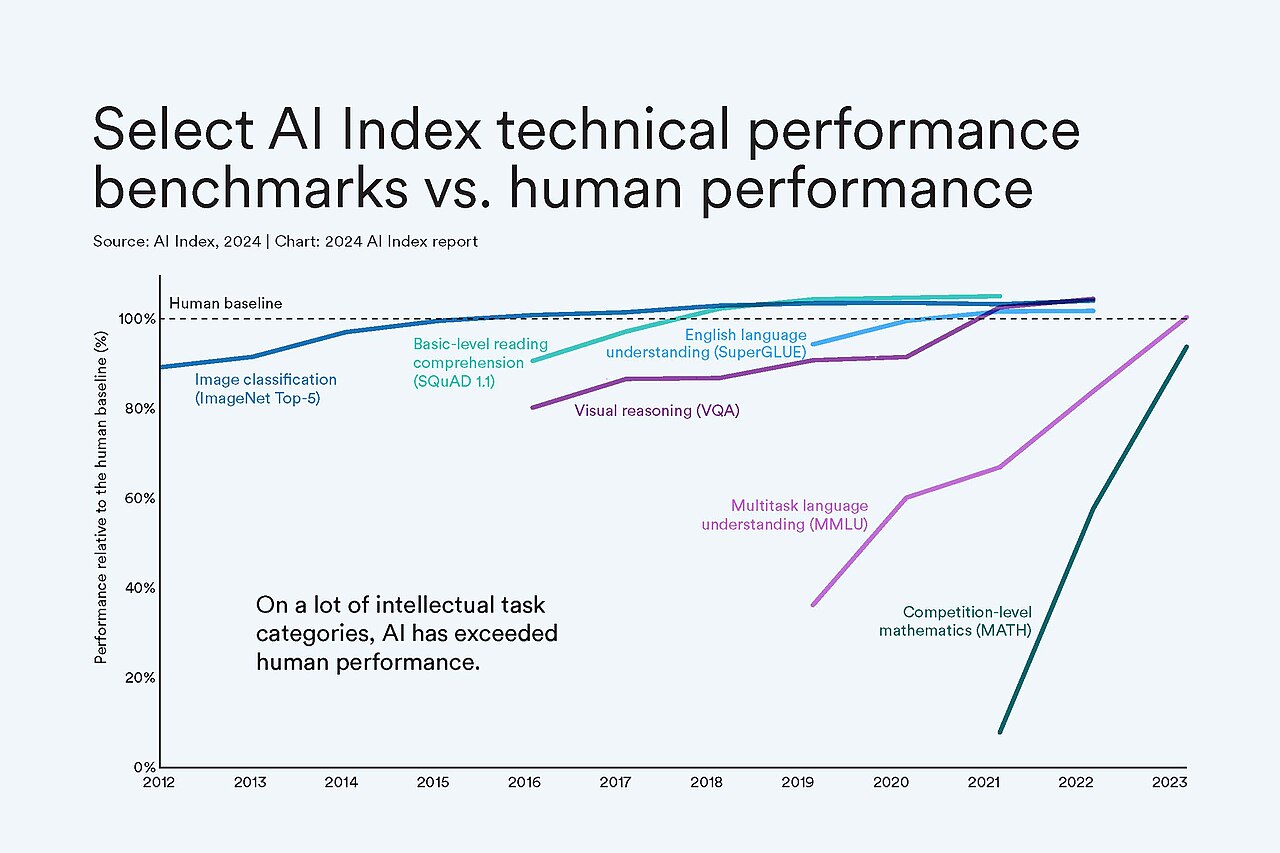

A hibák az emberi hibákhoz viszonyítva az irodalom szerint:

Az ember teljesítménye jó, ha meghaladja a 95%-ot.

A 2025-ös AI Index Report adatai szerint a modellek pontossága javulást mutatott a korábbi évekhez képest.

Kódolásban a SWE-bench teszten (szoftvermérnöki feladatok) a modellek sikeres megoldási aránya a 2023-as 4,4%-ról 2024 végére 71,7%-ra emelkedett. A képfelismerési és fordítási feladatok pontossága 2025-re elérheti, esetleg meghaladhatja a 95%-ot. A komoly szintű tudományos kérdések esetén a modellek pontossága közel 50 százalékponttal javult egyetlen év alatt. Az AI eszközök a válaszok 28,9%-ában említenek meg konkrét, releváns weboldalakat forrásként, ami javítja az ellenőrizhetőséget. A speciális modellek (pl. orvosi diagnosztika, jogi elemzés, pénzügy) pontossága magasabb az általános modelleknél, de a felelős AI-irányelvek alkalmazása még 2026-ban is kihívást jelent a cégeknek.

Kitérő a józan észről: A "józan ész" alapú ügynökök (MCS-agent) lényege, hogy olyan bonyolult problémákra adnak gyors és egyszerű, kis hardver igényű, de közel kauzális értékű választ, amikor a tökéletes (optimális) megoldás kiszámítása túlságosan időigényes vagy technikai okokból nehéz. A természetes gondolkozás (józan paraszti ész, mérése NQ): a véleményeink azért egyeznek, mert közel azonos alapokról valaki ugyanarra a következtetésekre jut, amennyiben a gondolkozása természetes. Az "egyszerűség elve": két, az adott jelenséget egyformán jól leíró magyarázat közül az egyszerűbbet érdemes választani, és a Bayes döntés is hasonlóan választ. (Latinul „lex parsimoniae”, azaz a „tömörség elve”, azaz „Csak szükség esetén feltételezzük a sokféleséget”, https://en.wikipedia.org/wiki/Occam%27s_razor.) A józan ész válaszai a "Miért?" kérdésekre nem feltétlenül tudományos elemzések, hanem tapasztalatokon, megfigyeléseken alapulnak, pl. az időjárással kapcsolatos megfigyelések, de általában egybe esnek a tudományos érveléssel.

Döntéseknél az aktív következtetést (Active Inference modul) használja szimulációval: melyik cselekvés csökkenti leginkább a predikciós hibát, a jövőbeli bizonytalanságot, ami az AI fejlesztésében a hagyományos mélytanulás alternatívája, Az ágens olyan helyeken keres sztochasztikus approximációval és/vagy véletlen kereséssel, ahol még nem járt, hogy pontosítsa a modelljét.

Az Active Inference modul néhány tapasztalatból képes stabil következtetéseket levonni és adaptálódni, matematikai alapján (a Bayes-i valószínűségszámítás), könnyebb visszakövetni, hogy az AI miért hozott egy adott döntést, hogy milyen várakozás vezette az adott cselekvéshez. Mivel az algoritmus folyamatosan korrigálja magát az érzékszervi adatok alapján, kiválóan alkalmas olyan eszközökhöz, ahol kevés a számítási kapacitás, de gyors reakció kell a változó környezetre.

Univerzális AI Ügynök (MCS-Agent, meghatározás):

Az MCS-Agent (Machine Common Sense) egy olyan autonóm ügynök, amely a megfigyelésekből (multimodális bemenetek) egy belső modellt épít. Nem csupán statisztikai korrelációkat keres, hanem a fizikai valóság kauzális összefüggéseit (józan ész) sajátítja el. Célja az átmenet a statikus LLM-ekből a cselekvőképes AGI felé, Bayes-i valószínűségi keretrendszerben minimalizálva a jövőbeli bizonytalanságot.

Működési elv és Architektúra: Az ügynök nem generatív (nem pixeleket jósol), hanem reprezentatív: a környezet lényegi állapotváltozóit (latent variables) modellezi. A bemeneti adatokat (szöveg, kép, szenzoradatok) egy absztrakt latens térbe sűríti, kiszűrve a zajokat,

Maszkolásos önfelügyelt tanulással (pl. videórészletek elrejtése) sajátítja el az időbeli és logikai folytonosságot. A modell predikciós képességeit sztochasztikus approximációval finomítja. A rendszer az aktuális állapotot variációs Bayes-következtetéssel (vagy hierarchikus állapottér-modellekkel) frissíti, biztosítva a zajtűrést.

Active Inference (Aktív Következtetés) modul: a döntéshozatalnál az ügynök olyan akciókat választ, amelyek csökkentik a várható predikciós hibát (tanulás). maximalizálják a célfüggvényt (cselekvés). A döntés előtt az ügynök belső szimulációval futtatja le a lehetséges forgatókönyveket, így kockázatmentesen szelektál a kimenetek között. A hierarchikus latens reprezentáció miatt alacsony erőforrás-igényű, kisméretű hardvereken is futtatható.

Az MCS-Agent (Machine Common Sense) egy olyan autonóm ügynök, amely a megfigyelésekből (multimodális bemenetek) egy belső modellt épít. Nem csupán statisztikai korrelációkat keres, hanem a fizikai valóság kauzális összefüggéseit (józan ész) sajátítja el. Célja az átmenet a statikus LLM-ekből a cselekvőképes AGI felé, Bayes-i valószínűségi keretrendszerben minimalizálva a jövőbeli bizonytalanságot.

Működési elv és Architektúra: Az ügynök nem generatív (nem pixeleket jósol), hanem reprezentatív: a környezet lényegi állapotváltozóit (latent variables) modellezi. A bemeneti adatokat (szöveg, kép, szenzoradatok) egy absztrakt latens térbe sűríti, kiszűrve a zajokat,

Maszkolásos önfelügyelt tanulással (pl. videórészletek elrejtése) sajátítja el az időbeli és logikai folytonosságot. A modell predikciós képességeit sztochasztikus approximációval finomítja. A rendszer az aktuális állapotot variációs Bayes-következtetéssel (vagy hierarchikus állapottér-modellekkel) frissíti, biztosítva a zajtűrést.

Active Inference (Aktív Következtetés) modul: a döntéshozatalnál az ügynök olyan akciókat választ, amelyek csökkentik a várható predikciós hibát (tanulás). maximalizálják a célfüggvényt (cselekvés). A döntés előtt az ügynök belső szimulációval futtatja le a lehetséges forgatókönyveket, így kockázatmentesen szelektál a kimenetek között. A hierarchikus latens reprezentáció miatt alacsony erőforrás-igényű, kisméretű hardvereken is futtatható.

Az új fajta ügynök hibatűrő, a cél a legalább 98%-os döntési megbízhatóság. Elvárás, hogy a maradék hiba fehérzaj jellegű legyen (korrelálatlan és zérus várható értékű), ne pedig rendszerszintű torzítás. A maszkolt önfelügyelt tanulás miatt nagyságrendekkel kevesebb humán beavatkozást igényel, mint a hagyományos megerősítéses tanulás.

A "józan ésszel" alapú AI ügynök (MCS-AI agent, Machine Common Sense AI, pl. a JEPA) működése

1. Rendszerarchitektúra

Bemeneti réteg (Encoders: multimodális, Vision, Audio, Sensor), ami bemeneti adatot nem rekonstruálja, hanem egy alacsony dimenziós latens reprezentációba kódolja.

Modell-Predictor: egy lépéses prediktív hálózat, amely a jelenlegi állapot és a lehetséges beavatkozások alapján megjósolja a következő állapotokat.

Döntési modul (Active Inference Controller), amely kiválasztja ki a legkisebb bizonytalansággal és legnagyobb hasznossággal járó cselekvést.

2. Tanulási algoritmus és Optimalizálás

Tanulási mód: Self-supervised Learning (SSL).

Maszkolás: a bemeneti sorozat (pl. videó) 40-60%-át elfedjük. A modellnek a latens térben kell kitalálnia a hiányzó részeket.

Célfüggvény: Az Energy-Based Model (EBM) elvét követve minimalizálja a jósolt és a valós latens állapot közötti négyzetes távolságot

Optimalizáló: Stochasztikus Approximáció (pl. AdamW vagy LARS), amely a tanulási sebességet a bemeneti entrópiához igazítja.

Állapotbecslés: Variációs Bayes következtetés, amely a bizonytalanságot egy kovariancia-mátrixszal modellezi, nem csak pontszerű becslést ad.

3. Moduláris Specifikációk

Bemeneti réteg (Encoders: multimodális, Vision, Audio, Sensor), ami bemeneti adatot nem rekonstruálja, hanem egy alacsony dimenziós latens reprezentációba kódolja.

Modell-Predictor: egy lépéses prediktív hálózat, amely a jelenlegi állapot és a lehetséges beavatkozások alapján megjósolja a következő állapotokat.

Döntési modul (Active Inference Controller), amely kiválasztja ki a legkisebb bizonytalansággal és legnagyobb hasznossággal járó cselekvést.

2. Tanulási algoritmus és Optimalizálás

Tanulási mód: Self-supervised Learning (SSL).

Maszkolás: a bemeneti sorozat (pl. videó) 40-60%-át elfedjük. A modellnek a latens térben kell kitalálnia a hiányzó részeket.

Célfüggvény: Az Energy-Based Model (EBM) elvét követve minimalizálja a jósolt és a valós latens állapot közötti négyzetes távolságot

Optimalizáló: Stochasztikus Approximáció (pl. AdamW vagy LARS), amely a tanulási sebességet a bemeneti entrópiához igazítja.

Állapotbecslés: Variációs Bayes következtetés, amely a bizonytalanságot egy kovariancia-mátrixszal modellezi, nem csak pontszerű becslést ad.

3. Moduláris Specifikációk

Modul Technológia / Algoritmus Feladat

Kódoló (Encoder) Vision Transformer (ViT) vagy ResNet-backbone A nyers szenzoradatok absztrakciója.

Prediktor Recurrent Neural Network (RNN) vagy State-Space Model A világ dinamikájának szimulálása.

Szimulátor Monte Carlo Tree Search (MCTS) alapú belső hurok Forgatókönyvek futtatása a latens térben.

Hibaellenőrzés Kálmán- szűrő A predikciós hiba eőrejelzése.

Kódoló (Encoder) Vision Transformer (ViT) vagy ResNet-backbone A nyers szenzoradatok absztrakciója.

Prediktor Recurrent Neural Network (RNN) vagy State-Space Model A világ dinamikájának szimulálása.

Szimulátor Monte Carlo Tree Search (MCTS) alapú belső hurok Forgatókönyvek futtatása a latens térben.

Hibaellenőrzés Kálmán- szűrő A predikciós hiba eőrejelzése.

4. Megbízhatósági és futási paraméterek

Döntési pontosság, MCS-Benchmark környezetben.

Hiba-statisztika: az előrejelzési hiba eloszlása legyen Gauss-fehérzaj vagy egyenletes eloslású zaj. Ha a hiba korrelált, a modell automatikusan "finomhangolást" indít (Online Learning).

Latencia, késleltetés < 10ms (Edge hardveren, pl. NVIDIA Jetson vagy Coral TPU).

A modell kvantált mérete (INT8 vagy FP16) nem haladhatja meg a 250 MB-ot a gyors betöltés érdekében.

5. Az "Active Inference" matematikai logikája

Az ügynök nem csak a múltat nézi, hanem az Aktív Kövezkeztetés mérőszámát minimalizálja, ami biztosítja, hogy az AI "kíváncsi" legyen (felfedezze az ismeretlent a hiba csökkentése érdekében), de közben a biztonságos tartományban maradjon.

A Self-supervised Learning , az önfelügyelt tanulás egy gépi tanulás, és a lényege, hogy a modell az adatokból (pl. nyers szöveg, kép, videó) saját magának generál tanítójeleket, és nincs szükség arra, hogy emberek manuálisan megerősítsék az adatok besorolását. Az algoritmus próbafeladatokat old meg, amelyek során az adat egy részét elrejti vagy módosítja, és összehasonlítja az eredetivel. Maszkolás: ha egy mondatból kihagyunk szavakat, és a modellnek ki kell találnia a hiányzó részt a környező szavak alapján. Vagy egy képet véletlenszerűen elforgatunk, a modellnek pedig meg kell mondania, hány fokkal fordítottuk el. Pl. a videókockákat összekeverünk, és a helyes sorrendet kell visszaállítani.

"Józan ész" alapú univerzális AI (MCS-AI) rendszerfejlesztési problémái

Az állapottér (Joint Embedding): több bemenet (pl. kép és szöveg) esetén egy közös metrikus térbe képezzük le az adatokat, ahol veszteségfüggvények (pl. Triplet Loss) segítségével a "pozitív" párokat közelítik, a "negatívokat" pedig távolítják egymástól.

közös állapot-, reprezentációs tér (vagy látens tér) és az absztrakt állapotváltozók a modern mesterséges intelligencia terei. A megközelítés lehetővé teszi, hogy a rendszer a nyers, bonyolult adatok (pl. pixelek) helyett azok lényegét megragadó, alacsonyabb dimenziós jellemzőkkel dolgozzon. Egy olyan matematikai tér, ahol a különböző típusú vagy forrású adatok (pl. kép, szöveg, szenzoradatok) összehasonlíthatóvá és közösen feldolgozhatóvá válnak. A bemeneti adatokat "összenyomja", és csak a feladat szempontjából lényeges információkat tartja meg.

A térben a hasonló jelentésű dolgok egymáshoz közel helyezkednek el, még akkor is, ha a bemeneti alakjuk teljesen eltérő, így lehetővé válik, hogy például egy kép és egy leírás ugyanazt a pontot reprezentálja a térben, így a gép "megérti" az összefüggést közöttük.

Az absztrakt állapotváltozók olyan belső jellemzők, amelyeket a modell tanul meg az adatokból, és nem közvetlenül mérhető fizikai mennyiségek. Néha megfelelnek emberi fogalmaknak (pl. egy tárgy orientációja, színe vagy távolsága), még ha a gép csak számként látja is őket. Az absztrakt reprezentációk segítségével a modell könnyebben alkalmazza a tanultakat új, korábban nem látott helyzetekben. Az állapottér-modellekben a változók írják le a rendszer belső állapotát és annak időbeli változását. Az absztrakció során a lényegtelen részletek (háttérzaj, véletlen pixelhibák) elvesznek, amiért a döntéshozatal stabilabb lesz. A közös reprezentációs tér és az absztrakt állapotváltozók matematikai háttere a dimenziócsökkentés, a sokaság-hipotézis (manifold hypothesis) és a valószínűségi modellezés háromszögében értelmezhető.

közös állapot-, reprezentációs tér (vagy látens tér) és az absztrakt állapotváltozók a modern mesterséges intelligencia terei. A megközelítés lehetővé teszi, hogy a rendszer a nyers, bonyolult adatok (pl. pixelek) helyett azok lényegét megragadó, alacsonyabb dimenziós jellemzőkkel dolgozzon. Egy olyan matematikai tér, ahol a különböző típusú vagy forrású adatok (pl. kép, szöveg, szenzoradatok) összehasonlíthatóvá és közösen feldolgozhatóvá válnak. A bemeneti adatokat "összenyomja", és csak a feladat szempontjából lényeges információkat tartja meg.

A térben a hasonló jelentésű dolgok egymáshoz közel helyezkednek el, még akkor is, ha a bemeneti alakjuk teljesen eltérő, így lehetővé válik, hogy például egy kép és egy leírás ugyanazt a pontot reprezentálja a térben, így a gép "megérti" az összefüggést közöttük.

Az absztrakt állapotváltozók olyan belső jellemzők, amelyeket a modell tanul meg az adatokból, és nem közvetlenül mérhető fizikai mennyiségek. Néha megfelelnek emberi fogalmaknak (pl. egy tárgy orientációja, színe vagy távolsága), még ha a gép csak számként látja is őket. Az absztrakt reprezentációk segítségével a modell könnyebben alkalmazza a tanultakat új, korábban nem látott helyzetekben. Az állapottér-modellekben a változók írják le a rendszer belső állapotát és annak időbeli változását. Az absztrakció során a lényegtelen részletek (háttérzaj, véletlen pixelhibák) elvesznek, amiért a döntéshozatal stabilabb lesz. A közös reprezentációs tér és az absztrakt állapotváltozók matematikai háttere a dimenziócsökkentés, a sokaság-hipotézis (manifold hypothesis) és a valószínűségi modellezés háromszögében értelmezhető.

A felügyelet nélküli szakaszban az alábbi kockázatok, hibák merülnek fel, kb. 98%-ban (amiből következik, hogy a hibaanalízis és az értékelés fontos része a fejlesztésnek):

Helytelen értelmezés: Világos iránymutatás nélkül az ügynökök rossz következtetésekre juthatnak és a kitűzött céllal ellentétes akciókat hajthatnak végre.

Biztonsági rések: Az autonóm módon kommunikáló ügynökök hálózatai váratlan mellékhatásokat produkálhatnak, amiket senki sem programozott be közvetlenül.

Etikai dilemmák: Kérdéses, hogy egy AI megtagadhat-e "etikátlan" emberi utasításokat, vagy képes-e felelős döntést hozni kritikus helyzetekben.

Ezért a jelenlegi megközelítés ma inkább "Human-in-the-Loop" működés. A legtöbb szakértő szerint a teljes felügyeletmentesség ma még nemlétező, helyette olyan keretrendszereket (pl. LangGraph, CrewAI) használnak, ahol az AI önállóan dolgozik, de a kritikus pontokon vagy nagy kockázatú döntéseknél (pl. pénzügyi tranzakció, kódmódosítás) megáll, és emberi jóváhagyást kér: Itt tartunk.

Biztonsági rések: Az autonóm módon kommunikáló ügynökök hálózatai váratlan mellékhatásokat produkálhatnak, amiket senki sem programozott be közvetlenül.

Etikai dilemmák: Kérdéses, hogy egy AI megtagadhat-e "etikátlan" emberi utasításokat, vagy képes-e felelős döntést hozni kritikus helyzetekben.

Ezért a jelenlegi megközelítés ma inkább "Human-in-the-Loop" működés. A legtöbb szakértő szerint a teljes felügyeletmentesség ma még nemlétező, helyette olyan keretrendszereket (pl. LangGraph, CrewAI) használnak, ahol az AI önállóan dolgozik, de a kritikus pontokon vagy nagy kockázatú döntéseknél (pl. pénzügyi tranzakció, kódmódosítás) megáll, és emberi jóváhagyást kér: Itt tartunk.

A MCS-AI: a technológiai világban az egyik legnagyobb kihívás a "józan ész"*** (common sense) átültetése a digitális ágensekbe az AGI felé történő fejlesztésben. Míg egy egyszerű AI ügynök képes bonyolult kódokat, programokat írni, gyakran elbukik az olyan alapvető dolgokon, amiket egy kisgyerek is tud: a fizikai világ, az emberi környezet ismeretén. A fizika tudománya egy modell, ami prediktorként jól értelmezhető: a fizikai modell alapján megjósoljuk, hogy adott feltételek teljesülése esetén mi történhet, vagy minek kell történni. Például tudni lehet, hogy ha elengedünk egy poharat, az leesik és összetörhet. A továbbiakban pszichológiai alapok esetén cél megérteni az emberi szándékokat és társadalmi normákat. Általános szituáció és helyzetfelismerésnél különbséget kell tennie egy pihenő munkás és egy rosszul lett ember között (ún. "Spatial Common Sense"). Van nagy modell, a NVIDIA Cosmos, ami sokat tud, de kéne egy kis, asztali változat, talán a gépi józan ész, a MCS-AI modell az lesz.

A gépi józan ész, a MCS-AI régóta kritikus és hiányzó eleme az AI-nak. A gépi tanulás terén vannak jó eredmények, de a gépi gondolkodás ezekben az alkalmazásokban továbbra is szűk és specializált. A jelenlegi gépi tanulási rendszereket minden egyedi helyzetre gondosan kell képezni vagy programozni. Az emberek nincsenek tudatában a józan ész hatalmának, amely minden kijelentés vagy cselekvés alapját képezi.

A józan ész úgy definiálható, mint „az alapvető képesség arra, hogy a körülvevő fizikai világot érzékeljünk, megértsünk és megítéljünk, ez a tudás minden emberben közös, és amely szinte minden embertől vita nélkül ésszerűen elvárható.” A közös, feltételezett háttértudás magában foglalja a fizikai világ működésének általános megértését (azaz a világ fizikáját, ami a világmodell), az emberi indítékok és viselkedés alapvető megértését (azaz az intuitív pszichológiát), valamint az átlagos felnőtt által birtokolt általános tények ismeretét. Az univerzális józan ész alapú AI-ügynöknek tisztában kell lennie a döntéseinek a következményeivel is az emberi környezetére, a fizikai világra, ezért a fejlesztésében az AI prediktív képességei meghatározóak, ami a fejlesztés egyik legnehezebb része lesz.

A józan ész hiánya megakadályozza az intelligens rendszereket abban, hogy megértsék a világukat, ésszerűen viselkedjenek előre nem látható helyzetekben, természetesen kommunikáljanak az emberekkel, és tanuljanak az új tapasztalatokból. A józan ész hiányát tekintik a legjelentősebb akadálynak a mai szűken fókuszált AI-alkalmazások, és a jövőben remélt általánosabb, emberszerű AI rendszerek között.

A józan ész érvelésének természete megnehezíti a józan ész megfogalmazását és kódolását. A Gépi Józan Értelem (MCS) program két stratégiát követve igyekszik kezelni a gépi józan ész kihívását. Mindkettő a gépi józan észt számítási szolgáltatásként, vagy gépi józan ész szolgáltatásként képzeli el.

Az első stratégia célja olyan szolgáltatás létrehozása, amely a tapasztalatokból tanul, mint egy kisgyerek, hogy olyan számítási modelleket hozzon létre, amelyek utánozzák a gyermeki tanulás alapvető területeit tárgyak (intuitív fizika), ágensek és helyek (térbeli navigáció) tekintetében.

A második stratégia célja olyan szolgáltatás fejlesztése, amely videókból, a web olvasásából tanul, mint egy kutatókönyvtáros, hogy egy józan ész tudástárát hozza létre, amely képes megválaszolni a józan ész jelenségeivel kapcsolatos természetes nyelvi és képalapú kérdéseket.

A cél mind a két stratégia esetén olyan alap-, háttértudás megtanítása a gépnek, amit egy gyerek tud a világ működéséről:

- az összefüggések ismerete nélkül, amelyeket eltanul a tanítóitól,

- tapasztalatai, megfigyelései alapján megszerez,

- összefüggések, szabályok felismerésével, tanulással szerez.

- Az AI soha nem lesz kíváncsi, a gép problémafeltevésben, kutatási kérdések feltevésében gyenge!

A döntés előkészítő prediktív AI ügynökök: a prediktív AI olyan technológia, amely statisztikai módszerek és gépi tanulás segítségével elemzi a múltbeli adatokat, hogy mintázatokat azonosítson és megjósolja a jövőbeli eseményeket, trendeket vagy viselkedéseket. Amíg a generatív AI új tartalmakat hoz létre (például videókat generál*), a prediktív MCS-AI ügynök célja a következtetés a tanult ismeretek alapján, az előrelátó döntéstámogatás heurisztikus elvek alapján. Az algoritmusok több ezer tényezőt és évtizednyi adatot képesek elemezni, és a folyamat a következő fázisokból áll:

Adatgyűjtés: Történeti adatok (pl. vásárlási előzmények, szenzoradatok, piaci trendek) összegyűjtése.

Modellezés: Regressziós modellek, Bayes-becslés, Kálmán-szűrő, döntési fák vagy neurális hálózatok betanítása az adatokon.

Előrejelzés: Az ismeretlen kimenetel (pl. mikor fog elromlani egy gép) valószínűségének kiszámítása.

Gyakori üzleti felhasználásokra példák:

Vásárlói viselkedés: Megjósolja, mely ügyfelek fognak lemorzsolódni, vagy mely termékeket fogják legközelebb megvenni.

Karbantartás: Az iparban jelzi, ha egy alkatrész hamarosan tönkremegy, így megelőzhető a leállás,

Pénzügyek: Hitelkockázat elemzése és csalásmegelőzés (pl. gyanús bankkártyás tranzakciók kiszűrése).

Logisztika: Kereslet-előrejelzés, hogy a kereskedők pontosan tudják, miből mennyit kell készletezniük.

Modellezés: Regressziós modellek, Bayes-becslés, Kálmán-szűrő, döntési fák vagy neurális hálózatok betanítása az adatokon.

Előrejelzés: Az ismeretlen kimenetel (pl. mikor fog elromlani egy gép) valószínűségének kiszámítása.

Gyakori üzleti felhasználásokra példák:

Vásárlói viselkedés: Megjósolja, mely ügyfelek fognak lemorzsolódni, vagy mely termékeket fogják legközelebb megvenni.

Karbantartás: Az iparban jelzi, ha egy alkatrész hamarosan tönkremegy, így megelőzhető a leállás,

Pénzügyek: Hitelkockázat elemzése és csalásmegelőzés (pl. gyanús bankkártyás tranzakciók kiszűrése).

Logisztika: Kereslet-előrejelzés, hogy a kereskedők pontosan tudják, miből mennyit kell készletezniük.

Fontos korlát: az AI következtetései ma a tanítóadatokon és a matematikai optimumkeresésen alapulnak, nem pedig valódi tudatosságon vagy szubjektív tapasztaláson.

De léteznek egyszerű számítógépes soklépéses iteratív tapasztalati stratégiák (a szukcesszív approximációk): a leggyengébb, legkisebb valószínűségű elem, véletlen keresésénél a rossz lépések elhagyása, és lehető legjobb irányban lépni, ha a hiba előjelet vált.

Teljes, "sok" ismeret esetén a Bellman féle dinamikus programozás, a Bayes-becslés, a Kálmán-szűrő alkalmas algoritmusok, míg kevés rendszer ismeret esetén a sztochasztikus approximáció, a Monte Carlo keresés alkalmas algoritmusok optimum-keresésre.

Jelenlegi helyzet: bár már léteznek új ágensek, (pl. V-JEPA, a Manus vagy az OpenAI Operator), a teljes körű emberi szintű józan ész elérése még kezdeti kutatási fázisban van.

A betanítás problémái:

98% -os megbízhatóságnál védelmeket szükséges beépíteni, hogy a 2%-os tartományba tartozó hibáknál legyen védelme az ügynöknek. A különleges, a 3 szigmás intervallumon kivűl eső bemenő jeleket hagyja figyelmen kívűl. A Kálmán-szűrő egy lináris becslés, a nemlineáris (kaotikus) esetekre korlátozó feltételek szükségesek, egy ilyen feltétel a hiba zérus várható értékét egy mozgóátlaggal, egy másik a nagy szórású eseteket korlátozza.

Az MCS-AI modellje a valóság belső, tömörített reprezentációja kéne legyen, amely lehetővé teszi a gép számára, hogy ne csak felismerje az adatokat, hanem megértse az összefüggéseket és előre jelezze az események kimenetelét. Angolul intuitív fizikának nevezik, pl. az objektumok állandóságának, törvényeinek, pl. a gravitációnak, az ütközéseknek és a folyadékok viselkedésének megértését (pl. tudja, hogy egy pohár leesve kifolyik, összetörik).

Térbeli és időbeli tudatosság: a tárgyak 3D-s elhelyezkedésének és az események időbeli egymásutániságának (ok-okozati összefüggések) kezelése.

Társas és etikai dinamika: az emberi interakciók, szándékok és társadalmi normák modellezése, ami elengedhetetlen a biztonságos együttműködéshez.

Absztrakt következtetés: képesség arra, hogy egy korábban nem látott helyzetben is tervet készítsen a tanult fizikai és logikai szabályok alapján.

Társas és etikai dinamika: az emberi interakciók, szándékok és társadalmi normák modellezése, ami elengedhetetlen a biztonságos együttműködéshez.

Absztrakt következtetés: képesség arra, hogy egy korábban nem látott helyzetben is tervet készítsen a tanult fizikai és logikai szabályok alapján.

Az információ bevitelének lehetséges módjainak megvalósítása érdekes feladat lesz, mert az MCS-AI nem csak a saját adatbázisaiból tanul, hanem folyamatokon keresztül ismeri meg analizálja majd a világot: multimodális tanítás esetén a rendszer bemenetei egyszerre LLM-ek, videók, képek, szövegek és hangok. A modell ezeket összekapcsolva tanul.

Szenzoros adatgyűjtés: a fizikai AI (pl. robotok, önvezető autók) esetén kamerák, LiDAR, gyorsulásmérők és egyéb szenzorok biztosítják a valós idejű visszacsatolást, a tanuláshoz szükséges információt a környezetről.

Megerősítéses öntanulás (Reinforcement Learning): A gép próba interakcióba lép a környezettel (szimulációban, vagy a valóságban), és jutalmakat vagy büntetéseket kap a tetteiért, így tanulja meg a hatékony stratégiákat.

Szintetikus adatok és szimulációk: a valóságban való tanulás lassú és veszélyes lehet, sokszor ultra-realisztikus virtuális világokban, pl. az NVIDIA Omniverse szimulációval tanítja a gépet, ahol sok forgatókönyvet próbálhat ki rövid idő alatt.

Strukturált tudásbázisok és API-k: hagyományos módon, vállalati adatbázisokból, tudásgráfokból és webes adatgyűjtésből is érkeznek információk a ténybeli tudás bővítésére. Az MCS-AI világ-modelljei alapjaiban változtatják majd meg a robotikát és az önvezetést, mivel a korábbi, merev szabályrendszereket egy rugalmas, prediktív (előrejelző) szimulációval váltják fel.

Megerősítéses öntanulás (Reinforcement Learning): A gép próba interakcióba lép a környezettel (szimulációban, vagy a valóságban), és jutalmakat vagy büntetéseket kap a tetteiért, így tanulja meg a hatékony stratégiákat.

Szintetikus adatok és szimulációk: a valóságban való tanulás lassú és veszélyes lehet, sokszor ultra-realisztikus virtuális világokban, pl. az NVIDIA Omniverse szimulációval tanítja a gépet, ahol sok forgatókönyvet próbálhat ki rövid idő alatt.

Strukturált tudásbázisok és API-k: hagyományos módon, vállalati adatbázisokból, tudásgráfokból és webes adatgyűjtésből is érkeznek információk a ténybeli tudás bővítésére. Az MCS-AI világ-modelljei alapjaiban változtatják majd meg a robotikát és az önvezetést, mivel a korábbi, merev szabályrendszereket egy rugalmas, prediktív (előrejelző) szimulációval váltják fel.

Az önvezető autók esetén a korábbi rendszerek csak felismerték a tárgyakat, a modern önvezető világ-modellek már részben értik a forgalom dinamikáját: A Waymo World Model például képes "mi lenne, ha" típusú helyzeteket generálni. Ha egy autó lát egy labdát begurulni az útra, a modellje előrevetíti, hogy egy gyerek is követheti azt, és ennek megfelelően lassít.

Latens reprezentációra képesek, az autók nem képpontokat, hanem absztrakt fogalmakat (sebesség, tapadás, takarás) tárolnak el, így extrém időjárási körülmények (hóvihar, sűrű köd) között is tudják, hol kell lenniük a tárgyaknak, akkor is, ha épp nem látják őket tisztán (Ez volt a tárgyak megmaradásának elve.)

Latens reprezentációra képesek, az autók nem képpontokat, hanem absztrakt fogalmakat (sebesség, tapadás, takarás) tárolnak el, így extrém időjárási körülmények (hóvihar, sűrű köd) között is tudják, hol kell lenniük a tárgyaknak, akkor is, ha épp nem látják őket tisztán (Ez volt a tárgyak megmaradásának elve.)

A NVIDIA Glossary esetén a világ-modellek segítségével szintetikus adatokat generálnak, így az autó milliónyi veszélyes szituációt (pl. baleset elkerülése) gyakorolhat be virtuálisan, mielőtt kimenne a valódi utakra. Az NVIDIA -t gondoljuk a világ vezető kutató intézetének a fizika modellezésében, mert:

- NVIDIA Cosmos: letölthető eszközöket (pl. Cosmos Curator a GitHub-on) és modelleket kínál, amelyek képesek a jövőbeli állapotok előrejelzésére és szintetikus adatok generálására robotikai tervezéshez. Kifejezetten a fizikai mesterséges intelligencia (Physical AI) fejlesztésére hoztak létre. Alegfontosabb képességei a fizikai jelenségekkel kapcsolatban:

1. Fizikai világ megértése és szimulációja: a Cosmos modellek képesek megérteni és előrejelezni, hogyan viselkednek a tárgyak a valóságban, ami magában foglalja a gravitációt, az ütközéseket és az anyagok kölcsönhatásait, hasonlóan ahhoz, ahogy egy emberi agy ösztönösen tudja, mi történik, ha elengedünk egy poharat.

2. Videógenerálás és jóslás (Predictív modellek): a rendszer képes meglévő videók vagy képek alapján "kiszámolni" a következő képkockákat. Például a NVIDIA Developer megmutatja, mi történik egy autóval egy adott kanyarban (önvezetés fejlesztése). Vagy szimulálja a robotkarok mozgását és azok hatását a környező tárgyakra.

3. Logikai következtetés (Cosmos Reason): a Cosmos Reason nevű modellváltozat vizuális információk alapján képes "gondolkodni". Nemcsak látja a jelenetet, hanem értelmezi is a fizikai összefüggéseket (pl. felismeri, ha egy akadály veszélyes egy robot számára).

4. A NVIDIA Developer felhasználási területei elsősorban:

Robotok betanítása virtuális térben, mielőtt a valódi világba kerülnének.

Önvezető járművek számára kritikus forgalmi helyzetek szimulálása veszély nélkül.

Ipari automatizálásnál gyárak és raktárak digitális ikreinek (digital twins) létrehozása az NVIDIA Omniverse segítségével.

2. Videógenerálás és jóslás (Predictív modellek): a rendszer képes meglévő videók vagy képek alapján "kiszámolni" a következő képkockákat. Például a NVIDIA Developer megmutatja, mi történik egy autóval egy adott kanyarban (önvezetés fejlesztése). Vagy szimulálja a robotkarok mozgását és azok hatását a környező tárgyakra.

3. Logikai következtetés (Cosmos Reason): a Cosmos Reason nevű modellváltozat vizuális információk alapján képes "gondolkodni". Nemcsak látja a jelenetet, hanem értelmezi is a fizikai összefüggéseket (pl. felismeri, ha egy akadály veszélyes egy robot számára).

4. A NVIDIA Developer felhasználási területei elsősorban:

Robotok betanítása virtuális térben, mielőtt a valódi világba kerülnének.

Önvezető járművek számára kritikus forgalmi helyzetek szimulálása veszély nélkül.

Ipari automatizálásnál gyárak és raktárak digitális ikreinek (digital twins) létrehozása az NVIDIA Omniverse segítségével.

Az NVIDIA Cosmos nem csupán képeket generál, hanem a valóság fizikai szabályait kódolja egy MI-modellbe, elérhető a fejlesztők számára, bárki elkezdhet velük kísérletezni.

A használatuk több szinten történhet, részlete három pontban:

1. Letöltés és használat a Hugging Face-ről

Az NVIDIA a Hugging Face felületén tette közzé a Cosmos család különböző tagjait. Itt megtalálhatók a Cosmos Diffusion & Autoregressive modellek: 4 milliárdtól 14 milliárd paraméterig terjedő változatokban, amelyek szövegből vagy videóból képesek világállapotokat generálni.

Cosmos Tokenizers, képek és videók tömörítésére szolgáló neurális hálózatok, amelyek 8-szor hatékonyabbak a korábbi megoldásoknál.

Cosmos Guardrails: biztonsági szűrők, amelyek a generált tartalom helyességét ellenőrzik.

2. Fejlesztői eszközök a modellek futtatásához és finomhangolásához, az NVIDIA több eszközt is biztosít:

GitHub Repository: Az NVIDIA-Cosmos GitHub oldalon találhatók az inferencia- (futtató) és post-training (utótanítási) szkriptek.

NVIDIA NIM: A modellek mikroszolgáltatásként is futtathatók az NVIDIA NIM segítségével, ami egyszerűbbé teszi a skálázást.

ComfyUI integráció: a közösség már elkészítette az integrációt népszerű AI-generáló felületekhez is, így vizuális munkafolyamatokba (workflow) is beilleszthető a Cosmos videógenerálási képessége.

3. Fizikai AI és Robotika (Advanced): a komolyabb fejlesztőknek a Cosmos Cookbook nyújt segítséget:

Omniverse integráció: A modellek összekapcsolhatók az NVIDIA Omniverse platformmal, ahol a OpenUSD adatok segítségével, és fotorealisztikus, fizikailag pontos szimulációk hozhatók létre.

Robotvezérlés (Cosmos Policy): A modellek taníthatók robotkarok mozgatására vagy önvezető rendszerek döntéshozatalára is.

Az NVIDIA a Hugging Face felületén tette közzé a Cosmos család különböző tagjait. Itt megtalálhatók a Cosmos Diffusion & Autoregressive modellek: 4 milliárdtól 14 milliárd paraméterig terjedő változatokban, amelyek szövegből vagy videóból képesek világállapotokat generálni.

Cosmos Tokenizers, képek és videók tömörítésére szolgáló neurális hálózatok, amelyek 8-szor hatékonyabbak a korábbi megoldásoknál.

Cosmos Guardrails: biztonsági szűrők, amelyek a generált tartalom helyességét ellenőrzik.

2. Fejlesztői eszközök a modellek futtatásához és finomhangolásához, az NVIDIA több eszközt is biztosít:

GitHub Repository: Az NVIDIA-Cosmos GitHub oldalon találhatók az inferencia- (futtató) és post-training (utótanítási) szkriptek.

NVIDIA NIM: A modellek mikroszolgáltatásként is futtathatók az NVIDIA NIM segítségével, ami egyszerűbbé teszi a skálázást.

ComfyUI integráció: a közösség már elkészítette az integrációt népszerű AI-generáló felületekhez is, így vizuális munkafolyamatokba (workflow) is beilleszthető a Cosmos videógenerálási képessége.

3. Fizikai AI és Robotika (Advanced): a komolyabb fejlesztőknek a Cosmos Cookbook nyújt segítséget:

Omniverse integráció: A modellek összekapcsolhatók az NVIDIA Omniverse platformmal, ahol a OpenUSD adatok segítségével, és fotorealisztikus, fizikailag pontos szimulációk hozhatók létre.

Robotvezérlés (Cosmos Policy): A modellek taníthatók robotkarok mozgatására vagy önvezető rendszerek döntéshozatalára is.

MCS ügynök az alábbi minimális specifikációkkal már futtatható:

Tanítási fázisban a multimodális maszkolásos tanulás (kép, videó, hang) továbbra is komoly számítási kapacitást igényel, de töredékét egy GPT-4 szintű modellnek.

Futtatási fázisban, mert nem kell óriási szöveges adatbázisokat "mozgatnia", és a szimuláció a látens térben (tömörített matematikai térben) zajlik, az erőforrásigénye sokkal alacsonyabb. Az ügynök – ha már be van tanítva – kényelmesen elfut egy mai középkategóriás asztali gépen:

RAM: 16–32 GB elegendő.

GPU: Egy 8–12 GB VRAM-mal rendelkező kártya (pl. RTX 3060/4060) már ideális a szimulációk és a multimodális kódolás gyorsítására.

CPU: Egy modern 6-8 magos processzor elég a Bayes-i számításokhoz és az Active Inference modulhoz.

Futtatási fázisban, mert nem kell óriási szöveges adatbázisokat "mozgatnia", és a szimuláció a látens térben (tömörített matematikai térben) zajlik, az erőforrásigénye sokkal alacsonyabb. Az ügynök – ha már be van tanítva – kényelmesen elfut egy mai középkategóriás asztali gépen:

RAM: 16–32 GB elegendő.

GPU: Egy 8–12 GB VRAM-mal rendelkező kártya (pl. RTX 3060/4060) már ideális a szimulációk és a multimodális kódolás gyorsítására.

CPU: Egy modern 6-8 magos processzor elég a Bayes-i számításokhoz és az Active Inference modulhoz.

Összehasonlító táblázat, a hagyományos (generatív vagy tisztán statisztikai) AI és a vázolt MCS-Agent közötti alapvető különbségekre:

Jellemző Hagyományos AI (pl. LLM, RL) MCS-Agent (Józan ész AI)

Tanulási mód Felügyelt (címkézett adat) Önfelügyelt (Self-supervised); nyers adatból (video, kép) vagy megerősítéses (jutalom alapú). épít belső modellt.

Jellemző Hagyományos AI (pl. LLM, RL) MCS-Agent (Józan ész AI)

Tanulási mód Felügyelt (címkézett adat) Önfelügyelt (Self-supervised); nyers adatból (video, kép) vagy megerősítéses (jutalom alapú). épít belső modellt.

Feldolgozás Pixel/Token szintű (minden részletet kiszámol). Latens tér (Latent space); csak a lényegi állapotváltozókr

Logika Statisztikai korreláció (mi következik a múlt alapján). Kauzalitás (Okszerűség); érti a fizikai/logikai világ törvényszerűségeit legalább 98%-ban.

Döntéshozatal Fix szabályok vagy súlyozott valószínűség. Active Inference; a bizonytalanság aktív csökkentése

Erőforrás igény Óriási szerverparkok (GPU). Alacsony (Edge AI); kis hardveren, beágyazott rendszereken is futtatható.

Hiba jellege Hallucinációk, logikátlan "fekete doboz" hibák. Statisztikai fehérzaj; korrelálatlan, zérus várható értékű

Logika Statisztikai korreláció (mi következik a múlt alapján). Kauzalitás (Okszerűség); érti a fizikai/logikai világ törvényszerűségeit legalább 98%-ban.

Döntéshozatal Fix szabályok vagy súlyozott valószínűség. Active Inference; a bizonytalanság aktív csökkentése

Erőforrás igény Óriási szerverparkok (GPU). Alacsony (Edge AI); kis hardveren, beágyazott rendszereken is futtatható.

Hiba jellege Hallucinációk, logikátlan "fekete doboz" hibák. Statisztikai fehérzaj; korrelálatlan, zérus várható értékű

hiba (98% feletti pontosság).

Kockázatkezelés "Próba-szerencse" a valóságban. Belső szimuláció; mentális "forgatókönyv-futtatás" a cselekvés előtt.

Alkalmazkodás Újratanítást igényel új környezetben. Rugalmas adaptáció; a Bayes-szabály miatt gyorsan adaptálódik az az új bemenetekhez.

Az MCS-AI ügynök típus alkalmas lehet helyi, eszközön történő futtatásra, például robotokban vagy okosotthon-központokban, ahol nincs állandó felhőkapcsolat. A fejlesztési célok: optimalizálás az adott feladatok elvégzésére, lehetőleg moduláris felépítéssel. A 98%-os működés alkalmassá teszi adaptációra. Pl. karbantartó AI-ügynököknél a megelőző karbantartás esetén az IoT-szenzorok adatait, karbantartási naplókat és üzemi adatokat elemezve az ügynökök képesek megjósolni egy alkatrész meghibásodását, mielőtt az leállítaná a termelést.

Kockázatkezelés "Próba-szerencse" a valóságban. Belső szimuláció; mentális "forgatókönyv-futtatás" a cselekvés előtt.

Alkalmazkodás Újratanítást igényel új környezetben. Rugalmas adaptáció; a Bayes-szabály miatt gyorsan adaptálódik az az új bemenetekhez.

Az MCS-AI ügynök típus alkalmas lehet helyi, eszközön történő futtatásra, például robotokban vagy okosotthon-központokban, ahol nincs állandó felhőkapcsolat. A fejlesztési célok: optimalizálás az adott feladatok elvégzésére, lehetőleg moduláris felépítéssel. A 98%-os működés alkalmassá teszi adaptációra. Pl. karbantartó AI-ügynököknél a megelőző karbantartás esetén az IoT-szenzorok adatait, karbantartási naplókat és üzemi adatokat elemezve az ügynökök képesek megjósolni egy alkatrész meghibásodását, mielőtt az leállítaná a termelést.

Képesek már ma is önállóan munkalapokat létrehozni, priorizálni a feladatokat, és alkatrészeket is rendelni, ha a készletszint kritikus alá süllyed.

Az SAP AI-ügynökei az üzleti folyamatok és eszközök állapotának felügyeletére is használhatók. Vannak már speciális platformok, mint a Virtualworkforce.ai, melyek karbantartó és létesítménykezelő csapatok számára fejlesztenek célorientált MI-ágenseket.

Az SAP AI-ügynökei az üzleti folyamatok és eszközök állapotának felügyeletére is használhatók. Vannak már speciális platformok, mint a Virtualworkforce.ai, melyek karbantartó és létesítménykezelő csapatok számára fejlesztenek célorientált MI-ágenseket.

AI karbantartás

A mai ügynökök hibrid ügynökök, melyeket univerzális alakra kéne hozni, ha megengedett a 98% "-os hiba

Mai széles körben alkalmazandó "józan eszű" intelligens univerzális ügynökről: még nem léteznek olyan intelligens ügynökök, amelyek egyszerre lennének széles körben alkalmazhatóak és rendelkeznének az emberi értelemben vett „józan ésszel”, de hibrid modellek már léteznek. Bár a speciális célú AI-ügynökök fejlesztése 2025-ben és 2026-ban hatalmas lendületet vett, a technológia jelenleg a „Human-in-the-Loop” AI kategóriájába tartozik, mert:.

Alkalmazhatóság: Már léteznek horizontális ügynökök, amelyeket több iparágban is használnak, például az ügyfélszolgálatban (pl. Klarna) vagy alapvető digitális asszisztensként.

Képességek: A modern ügynökök nagy nyelvi modellekre (LLM) épülnek, rendelkeznek rövid és hosszú távú memóriával, és képesek külső szoftveres eszközöket használni (pl. naptárkezelés, böngészés).

Elterjedtség: A vállalatok jelentős része (kb. 35%-a) már kísérletezik autonóm ügynökökkel, de a teljes körű bevezetés még várat magára.

A kutatók szerint a józan ész alapú érvelés az egyik legnehezebb akadály az AI előtt, mert a kontextusfüggés kezelése nem tökéletes. Az AI modellek statisztikai valószínűségek alapján generálnak válaszokat, de nem értik valódi mélységében a hétköznapi fizikai világot vagy az emberi szándékokat. Míg egy ember tudja, hogy egy diétázó vendégnek is lehet „csalónapja”, az AI-nak gondot okozhat az ilyen finom, ellentmondásos információk rugalmas kezelése. A teljes körű autonómiát (AGI - Általános Mesterséges Intelligencia) gátolja, hogy az ügynökök még mindig hajlamosak logikai hibákra vagy „hallucinációkra”.

Képességek: A modern ügynökök nagy nyelvi modellekre (LLM) épülnek, rendelkeznek rövid és hosszú távú memóriával, és képesek külső szoftveres eszközöket használni (pl. naptárkezelés, böngészés).

Elterjedtség: A vállalatok jelentős része (kb. 35%-a) már kísérletezik autonóm ügynökökkel, de a teljes körű bevezetés még várat magára.

A kutatók szerint a józan ész alapú érvelés az egyik legnehezebb akadály az AI előtt, mert a kontextusfüggés kezelése nem tökéletes. Az AI modellek statisztikai valószínűségek alapján generálnak válaszokat, de nem értik valódi mélységében a hétköznapi fizikai világot vagy az emberi szándékokat. Míg egy ember tudja, hogy egy diétázó vendégnek is lehet „csalónapja”, az AI-nak gondot okozhat az ilyen finom, ellentmondásos információk rugalmas kezelése. A teljes körű autonómiát (AGI - Általános Mesterséges Intelligencia) gátolja, hogy az ügynökök még mindig hajlamosak logikai hibákra vagy „hallucinációkra”.

2025/2026 években az ügynökök: az OpenAI és az SAP olyan megoldásokat mutattak be, amelyek képesek a felhasználó nevében összetett munkafolyamatokat (pl. utazásfoglalás, piackutatás) végrehajtani. Hibrid megoldásaik: a kutatók neuro-szimbolikus AI -val és tudásgráfokkal próbálják „beoltani” a modelleket józan ésszel. Funkcionális ügynökeink már vannak, de „józan paraszti ésszel” alapú, univerzális AI ügynökök még nincsenek, a mai modellek hibrid modellek. Bár az autonómia szintje folyamatosan nő, a kritikus döntéseknél (pl. jogi vagy pénzügyi területen) jelenleg még szükséges az emberi felügyelet („human-in-the-loop”) a biztonság és a pontosság érdekében. Itt tartunk. Az automatizálás és a robotok egyes területein már sikerült az emberi felügyeletet megszüntetni. Az okos szemüveges* alkalmazás sajátossága, hogy az ember mindig jelen van, tehát első lépésben várhatóan sikeres lesz a fejlesztése.

*Az AMI technológiáját a Meta okos szemüvegében is bevethetik, amit az egyik legközelebbi lehetséges felhasználási területnek nevezte. Az okos szemüveges AI-rendszerek: a mesterséges intelligencia és a kiterjesztett valóság (AR) ötvözésével kínálnak interaktív élményt, ahol a szemüveg nemcsak megjelenít, hanem "lát" és értelmez is. Az eszközök kamerák és szenzorok segítségével valós időben dolgozzák fel a környezetet, így képesek hangalapú és kép asszisztenciára, szövegfordításra vagy tárgyfelismerésre.

A szemüvegek főbb funkciói és alkalmazási területei ma:

Valós idejű elemzés: A rendszer felismeri a környezeti tárgyakat, feliratokat és arcokat.

Aktivitáskövetés: Egyes modellek figyelik a mozgást, lépésszámot és akár a testtartást is.

Ipar és egészségügy: Segítik a precíziós munkavégzést, az orvosi diagnosztikát vagy speciális állapotok (pl. rövidlátás, más látás hibák) kezelését.

Személyi asszisztensként a hangalapú irányítás és azonnali információlekérés anélkül, hogy elő kellene venni a telefont.

Valós idejű elemzés: A rendszer felismeri a környezeti tárgyakat, feliratokat és arcokat.

Aktivitáskövetés: Egyes modellek figyelik a mozgást, lépésszámot és akár a testtartást is.

Ipar és egészségügy: Segítik a precíziós munkavégzést, az orvosi diagnosztikát vagy speciális állapotok (pl. rövidlátás, más látás hibák) kezelését.

Személyi asszisztensként a hangalapú irányítás és azonnali információlekérés anélkül, hogy elő kellene venni a telefont.

A Meta főbb technológiái és funkciói:

Meta AI & Multimodalitás: A szemüveg képes "látni" és értelmezni a környezetet (pl. "Nézd meg ezt a növényt, és mondd meg, mi a neve!").

Meta Neural Band: A kijelzős modellekhez (Display) tartozó csuklópánt, amely az izomjelek (EMG) alapján teszi lehetővé a szemüveg irányítását finom kézmozdulatokkal.

Integrációk: Közvetlen kapcsolat a WhatsApp, Messenger és Instagram rendszerekkel, lehetővé téve a hangalapú üzenetküldést vagy az élő közvetítést.

Meta AI & Multimodalitás: A szemüveg képes "látni" és értelmezni a környezetet (pl. "Nézd meg ezt a növényt, és mondd meg, mi a neve!").

Meta Neural Band: A kijelzős modellekhez (Display) tartozó csuklópánt, amely az izomjelek (EMG) alapján teszi lehetővé a szemüveg irányítását finom kézmozdulatokkal.

Integrációk: Közvetlen kapcsolat a WhatsApp, Messenger és Instagram rendszerekkel, lehetővé téve a hangalapú üzenetküldést vagy az élő közvetítést.

A videogenerálás: A Sora az OpenAI multimodális MI-fejlesztése, a megoldás a Meta és az Alphabethez tartozó Google szövegből videót generáló eszközeivel versenyez. Míg a szövegalapú AI-modellek már széles körben elterjedtek az otthoni és a munkahelyi felhasználásban, a kép- és videógenerálásra specializálódott rendszerek jelentik a technológiai iparág következő nagy ugrását. Az OpenAI 2025 szeptemberében indította el a Sorát önálló alkalmazásként. A rendszerben a felhasználók szöveges utasítások (promptok) alapján hozhatnak létre és oszthatnak meg mesterséges intelligencia által generált videókat. Ezeket a tartalmakat a közösségi médiához hasonló hírfolyamokban is közzétehetik. Az önálló Sora alkalmazás a ChatGPT-be történő integrációt követően is zavartalanul működik majd.

**Egy javaslat: hibatűrő "józan ész"alapú univerzális AI ügynök esetén

- megengedett hibakategóriákat definiálunk (a hibaanalízis egyben értékelés, jutalmazás, része a betanításnak):

A megengedett hibánál az AI miért téveszt? (Nem megengedett hibánál meg kell állítani.)

-A bemenő adatok hibásak,

- Kevés bemenő adat miatt pontatlan az AI információ készlete,

- A kérdés megfogalmazása pontatlan,

- Az AI pontatlanul következtet,

- A felhasználó félre értelmezi az egyébként helyes választ, pl. szokatlan szóhasználat (ami egy mintázat) miatt.

- Az AI meghív sokféle -matematikai, zenei és videószerkesztő- algoritmust, melyek tartalmaznak látens hibákat

- A gépi programírás, a "vibe coding”, amikor a fejlesztő leírja mit szeretne, a kódot pedig az AI állítja elő. A végeredmény biztonsági szempontból viszont kockázatos. Ismert példa, ha a véletlenszám generátor saját magát ismétli.

- Egy új megkötés, hogy az MCS-AI ügynök hibáira előírjuk, hogy korrelálatlanok legyenek az előrejelzésekkel, következmény, hogy zérus várható értékűek, amit biztosítunk akkor is, ha lokálisan éppen nem teljesül. A korrelálatlanság mutatja a sikeres tanulást, kritériumként is alkalmas!

- Első lépésben figyelmen kívül hagyható, hogy a gépnek, pl. az áramellátásának is van megbízhatósága, ami a rendelkezésre állás valószínűsége, a rendelkezésre állás idejének százalékában adják meg, pl. 99.999.

(Ha minden tévesztéshez tudnánk ismert %-ot rendelni, a válasz pontosságát százalékokban úgy kapnánk, hogy a szorzatot elosztjuk 100 annyiadik hatványával, ahány tényezőt összeszoroztunk.)

-a nem megengedett hibánál meg kell állnia a gépnek a tanítási szakaszban, ezért fontos a hibakategóriák pontos meghatározása.

Az értelmezést egy szó kontextusának, szövegkörnyezetének nevezik az irodalomban. A szövegértelmezéssel történő fordítást 2017-ben kezdték csak használni a nyelvi modellekben, de a felismerés az 1950-es évekből származik: Danica Seleskovitch (1921–2001), egy neves francia tolmács és kutató volt, aki az 1950-es évektől dolgozta ki elméleti alapjait annak, amit ma szavak alapján történő értelmező

fordításelmélet-nek nevezünk.

Az MI szövegértelmezésének pontossága függ az elegendő mennyiségű bemeneti adatoktól, azaz megvannak-e szükséges és megfelelő mintázatai a gépnek a kérdésre vonatkozóan. Továbbá függ a kérdés pontosságától is, mert a gép a pontosan-pontatlanul feltett kérdéshez keres mintázatot. (A pontatlan kérdés mintázata mennyire fedi a pontos kérdés mintázatát?) Az MI pontatlan kérdés esetén a pontatlan kérdés mintázatára válaszol, hallucinál. Az is előfordulhat, hogy eltéved a mintázat keresésben, akkor is "hallucinál". Az adott kérdés témakörében kielégítő (min. 90%-os) input ismertekre van szüksége a kielégítő pontosságú, mintázatú válaszhoz.

Az AI pontossága %-okban? Ha egy tanuló legalább 80%-ban helyesen értelmez egy szöveget, amikor válaszol egy kérdésre, akkor minimum négyes osztályzatot érdemel. A "józan paraszti ész" legalább 80%-ban*** helyes. A legismertebb összehasonlító vizsgálat a Nature 2005-ös tanulmánya volt, amely szerint a Wikipédia tudományos szócikkei kb. azonos pontosságúak voltak, mint az Encyclopaedia Britannica cikkei (hibaszám alapján csak kis különbség volt). Későbbi vizsgálatok általában azt találták, hogy az MI által is idézett Wikipédia közel 90% pontosságú a stabil, jól követett témákban, de a friss, vitatott vagy szűk csoportokra vonatkozó témákban a pontosság jelentősen csökken. Lehetséges az AI pontosságát a helyes válaszok %-ában mérni, ami a megfelelő valószínűség százszorosa. 2025-ben a nagy hibrid AI-k pontossága már elérte a 90%-ot.

Javasolt teszt típus: valamely művelet és inverz művelete után az eredmények összehasonlítása, pl. oda-vissza fordítás, képszerkesztés visszafordítása. Nyilván a pontosság műveletenként változik, és nem minden esetben tesztelhető az inverz művelet.

***A természetes gondolkozás (józan paraszti ész, NQ): a véleményeink azért egyeznek, mert közel azonos alapokról valaki ugyanarra a következtetésekre jut, ha a gondolkozása természetes. Az "egyszerűség elve": két, az adott jelenséget egyformán jól leíró magyarázat közül az egyszerűbbet érdemes választani. (Latinul „lex parsimoniae”, azaz a „tömörség elve”, azaz „Csak szükség esetén feltételezzük a sokféleséget”. A józan ész válaszai a "Miért?" kérdésekre nem feltétlenül tudományos válaszok, hanem tapasztalatokon, megfigyeléseken alapulnak, általában egybe esnek a tudományos érveléssel.

A mindennapi józan ész logikája azt jelenti, ahogyan az emberek természetes módon következtetnek a világban szerzett hétköznapi tapasztalataik alapján: rugalmas, tapasztalat-alapú gondolkodás, amely gyorsan és hatékonyan működik hétköznapi helyzetekben. A józan ész logikája segít a túlélésben, megóv hibás döntésektől általában, és gyors döntéshozatalt tesz lehetővé, a helyzetek legvalószínűbb alapértelmezéséit adja. Mások tapasztalatain alapul, a legvalószínűbb kimenetelt, egyszerű, gyakorlati megoldásokat keres, és nézőpontok váltásával fejleszthető.

A Bayes-féle valószínűség szubjektív magyarázata kb. egy évszázada még elfogadott volt, a valószínűséget nem Kolgomorov-mértékként, nem a mérnöki szemlélet szerinti gyakoriságként értelmezte, hanem a meggyőződés vagy a bizonytalanság mértékeként, ahol egy adott kijelentés igazságtartalmát tükrözte, ami eltérő a rendelkezésre álló információ szerint. Az a priori megismerés folyamata egy kezdeti szubjektív valószínűség-gel kezdődik: egy adott személy mit feltételez egy jelenségről. Az adatok megismerése után az valószínűséget a Bayes-tétel segítségével, a szubjektív hiedelmet módosítjuk, frissítjük, amíg objektív lesz. A kezdeti szubjektív meggyőződések eltérhetnek, a megfelelő mennyiségű új adat hatására a bayesiánus frissítés során ezek a kezdeti különbségek "kimosódnak", és a végeredmény közelít egymáshoz, és az objektívhez. A módszert olyan esetekben alkalmazzák, ahol nincs elegendő ismételhető kísérlet (pl. kriminalisztika, kockázatelemzés, bizonytalan tudás kezelése), így a szakértői becslésekre és a Bayes-hálókra építenek. A szubjektív Bayes-valószínűség keretet ad a bizonytalan tudás kezelésére, amely összekapcsolja a szubjektív értékítéleteket az adatokból leszűrt következtetésekkel.

A szakértői Bayes-becslések statisztikai módszerek, lehetővé teszik a szakértői vélemények, a szubjektív tudás matematikai beillesztését adatvezérelt elemzésekbe. A rekurzív becslés a már meglévő információk alapján kezdődik egy választott Likelihood feltételes sűrűségfüggvénnyel, ami az adatok valószínűsége a feltételezett paraméterek mellett. A becslés a Bayes-tétel segítségével az új adatok egyesítése, amely egy frissített, pontosabb becslést eredményez. A szakértői becslések különösen akkor hasznosak, ahol kevés a rendelkezésre álló adat, vagy a bizonytalanság mértéke magas: pl. DNS-minták vagy ujjnyomok bizonyító erejének számszerűsítése. Orvostudományban a diagnózisok felállítása és terápiás hatások becslése ritka betegségek esetén. Kockázatelemzésben az események (pl. ipari katasztrófák) valószínűségének meghatározása, amelyekről nincs elég történelmi statisztika. Gépjármű-navigációnál a szenzoradatok és korábbi mozgásminták alapján történő állapotbecslés.

Lehetővé teszi a "találgatások" beépítését a modellbe. Az elemzés frissíthető új adatok esetén, rekurzív a becslés, de a szubjektív likelihood függvény megválasztása egy ideig torzíthatja az eredményt, ha a szakértő első véleménye nem megalapozott, de legalább sztochasztikusan konvergál.

Lehetővé teszi a "találgatások" beépítését a modellbe. Az elemzés frissíthető új adatok esetén, rekurzív a becslés, de a szubjektív likelihood függvény megválasztása egy ideig torzíthatja az eredményt, ha a szakértő első véleménye nem megalapozott, de legalább sztochasztikusan konvergál.

Az emberi természetes intelligencia (IQ) fő ismérvei: az ember képes a folyamatosan ismereteket gyűjteni, a változó körülményekhez alkalmazkodni, és a problémákat rugalmasan, a korábbi tapasztalatokból merítve megoldani. Az egyén képes új, eredeti ötletek, megoldások és alkotások létrehozására is, ami a mesterséges intelligencia számára utánozható terület. Az emberi speciális intelligencia többféle területen nyilvánul meg, például nyelvi, logikai-matematikai, vizuális-térbeli, zenei, mozgási formákban. Külön tesztelhető.

Érzelmi intelligencia (EIQ): magában foglalja a saját és mások érzelmeinek felismerését, megértését és kezelését, a képesség kulcsfontosságú a sikeres emberi interakciókban és a mentális jólétben. Képesség a másokkal való hatékony kommunikációra, együttműködésre, empátiára és a társas normák megértésére. Önreflexió és tudatosság esetén valaki képes önmagára, saját gondolataira, érzéseire és cselekedeteire reflektálni, vállalni a hibáit, és ezek tudatában fejlődni. Egy képesség, hogy tudatosan figyeljük és irányítsuk saját gondolkodási folyamatainkat, tanulási stratégiáinkat. Az emberi viselkedést gyakran belső motivációk vezérlik.

Az intellektus (ami mérhetetlen tesztekkel, https://www.origo.hu/tudomany/2026/01/mesterseges-intelligencia-kreativitas) meghatározása: az "intellektus" értelmi képességet, a tudatot, tudatost jelent. Magába foglalja az észlelés, az emlékezés, a gondolkodás, általánosítás, az elvonatkoztatás, az érvelés, eszközkeresés, készítés és a döntéshozatal képességeit. A (cél-) tudatosság és a célhoz az eszközkeresés, taktika- és stratégiakeresés a legmagasabb szintű integrált mentális tevékenységek, a humor magas rendű emberi tulajdonságok. Az intellektuálisan fejlett embereket az új problémák felismerése és megfogalmazása jellemzi, jól, jókor és jót kérdezni kevesek képessége, és sokkal nehezebb mint válaszolni.

****

A LeCun féle intuitív, naív fizikáról, intuitív fizikáról, melynek vannak korlátai, pl. hogy valamilyen hibaszázalékkal működik és sok fizikai jelenségnek még nem ad keretet.

Mi a legnagyobb kihívás a robotikában? (A Moravec-paradoxon) Ami nekünk, embereknek a legnehezebb (pl. magas szintű matematika, sakk), az az AI-nek könnyű. Ami viszont nekünk a legtermészetesebb (pl. átmenni egy zsúfolt szobán anélkül, hogy levernénk valamit), az a robotoknak elképesztően nehéz. A robotok még mindig nehezen kezelik a puha, deformálódó tárgyakat (pl. egy ruhadarab összehajtása) vagy a kiszámíthatatlan anyagokat (pl. a méz csorgása), mert ezekre nincsenek jó „intuitív” tapasztalati szabályaik.

Bár kiválóan alkalmas a mindennapi túléléshez szükséges gyors becslésekre, néha ellentmond a tudományos valóságnak, mert nem az univerzális törvényeken, hanem a szubjektív tapasztalatokon alapul. A leíró (kvalitatív, fenomenológikus) megközelítés jellege miatt a következő korlátokkal rendelkezik:

1. Rendszerszintű tévképzetek: az intuíció olyan modelleket épít fel, amelyek "működnek" a hétköznapokban, de fizikailag hibásak, pl. Arisztotelészi szemlélet azt súgja, hogy egy tárgy mozgatásához folyamatos erőre van szükség, mert a súrlódást alapvető fizikai tulajdonságnak tekinti a tehetetlenség helyett. Ösztönösen azt lehet gondolni, hogy a nehezebb tárgyak gyorsabban esnek le, mert a légellenállás hatását összemossák a gravitációéval. Vagy körpályán haladva úgy érezzük, egy erő kifelé taszít minket, holott csak a tehetetlenségünk miatt haladnánk egyenesen tovább.

2. Vannak skálázhatósági korlátok is, az intuitív fizika csak a „középméretű” világban (emberi lépték, mérsékelt sebesség) használható:

A kvantumfizika jelenségei (pl. összefonódás, hullám-részecske kettősség) teljesen ellentmondanak az intuíciónak. Extrém nagy sebességeknél a relativitáselmélet (idődilatáció, hosszkontrakció) nem fogható fel józan ésszel.

3. A mennyiségi különbségek minőségi változást hozhatnak, és a leíró fizika nem tud mit kezdeni azzal a jelenséggel, ha a mértékek változása megváltoztatja a rendszer viselkedését. Egy szerkezet, ami kicsiben lehet stabil, nagyban összeomolhat a saját súlya alatt, mert a tömege (köbösen) gyorsabban nő, mint a tartófelülete (négyzetesen). Az időjárás vagy a kaotikus rendszerek kis változásai óriási eltéréseket okozhatnak, a nemlinearitást pusztán leíró módon képtelenség megjósolni.

4. Bizonytalanság, zajos rendszerek esetén az intuitív fizika torz, „zajos” adatokkal dolgozik. Az érzékszerveink (látás, egyensúly) pontatlanok, így az ezekre épülő következtetések is gyakran tévesek. Például hajlamosak vagyunk túlbecsülni egy ütköző tárgy tömegét pusztán a sebessége alapján.

1. Rendszerszintű tévképzetek: az intuíció olyan modelleket épít fel, amelyek "működnek" a hétköznapokban, de fizikailag hibásak, pl. Arisztotelészi szemlélet azt súgja, hogy egy tárgy mozgatásához folyamatos erőre van szükség, mert a súrlódást alapvető fizikai tulajdonságnak tekinti a tehetetlenség helyett. Ösztönösen azt lehet gondolni, hogy a nehezebb tárgyak gyorsabban esnek le, mert a légellenállás hatását összemossák a gravitációéval. Vagy körpályán haladva úgy érezzük, egy erő kifelé taszít minket, holott csak a tehetetlenségünk miatt haladnánk egyenesen tovább.

2. Vannak skálázhatósági korlátok is, az intuitív fizika csak a „középméretű” világban (emberi lépték, mérsékelt sebesség) használható:

A kvantumfizika jelenségei (pl. összefonódás, hullám-részecske kettősség) teljesen ellentmondanak az intuíciónak. Extrém nagy sebességeknél a relativitáselmélet (idődilatáció, hosszkontrakció) nem fogható fel józan ésszel.

3. A mennyiségi különbségek minőségi változást hozhatnak, és a leíró fizika nem tud mit kezdeni azzal a jelenséggel, ha a mértékek változása megváltoztatja a rendszer viselkedését. Egy szerkezet, ami kicsiben lehet stabil, nagyban összeomolhat a saját súlya alatt, mert a tömege (köbösen) gyorsabban nő, mint a tartófelülete (négyzetesen). Az időjárás vagy a kaotikus rendszerek kis változásai óriási eltéréseket okozhatnak, a nemlinearitást pusztán leíró módon képtelenség megjósolni.

4. Bizonytalanság, zajos rendszerek esetén az intuitív fizika torz, „zajos” adatokkal dolgozik. Az érzékszerveink (látás, egyensúly) pontatlanok, így az ezekre épülő következtetések is gyakran tévesek. Például hajlamosak vagyunk túlbecsülni egy ütköző tárgy tömegét pusztán a sebessége alapján.

5. A klasszikus példa az úgynevezett „görbe cső feladat”, amely tökéletesen rávilágít az intuitív (vagy naiv) fizika és a valódi mechanika közötti különbségre. A feladat a kanyarodó golyó pályája egy az asztalon fekvő, félkör alakú csőben. Egy golyót nagy sebességgel belelövünk a cső egyik végén, amely végigszalad a kanyarban, majd a túlsó végén kirepül a szabadba.

Kérdés, hogy milyen útvonalon halad tovább a golyó, miután elhagyta a csövet? Az intuitív válasz (gyakori tévedés), hogy a golyó a cső elhagyása után is görbe vonalon halad tovább egy darabig, mintha a cső „belekényszerítette” volna a kanyarodást, míg a valóságban a golyó az elhagyás pillanatában azonnal egyenes vonalban halad tovább a kilépési pont érintője mentén.

Miért vezet félre néha az intuíció? Az agyunk a mindennapi tapasztalatokból (pl. kanyarodó autó, eldobott tárgyak) egy olyan belső modellt épít fel, ami nem tesz különbséget a tehetetlenség és az erő között. Ösztönösen azt hisszük, hogy a mozgáshoz „bele kell tölteni” valamilyen belső hajtóerőt a tárgyba. Ha a tárgy kanyarodik, az intuíció szerint ez a „kanyarodó erő” is benne marad a golyóban. Ezzel szemben a fizika kimondja, hogy egy test mozgásállapota (iránya és sebessége) csak akkor változik meg, ha külső erő hat rá. Amint a golyó kilép a csőből, megszűnik a cső falának kényszerítő ereje, így a tehetetlensége miatt egyenesen repül tovább.

További gyakori „beugratós” példák: az intuíció azt diktálja, hogy a nehezebb tárgy gyorsabban esik le. Vákuumban azonban egy kalapács és egy madártoll pontosan egyszerre ér földet, mert a gyorsulás független a tömegtől.

További gyakori „beugratós” példák: az intuíció azt diktálja, hogy a nehezebb tárgy gyorsabban esik le. Vákuumban azonban egy kalapács és egy madártoll pontosan egyszerre ér földet, mert a gyorsulás független a tömegtől.

Az intuitív fizika legnagyobb előnye a sebesség és a hatékonyság. Míg egy szuperszámítógépnek is hosszú időbe telne kiszámítani a légellenállást, a gravitációt, a labda perdületét és a szél sebességét, te egy pillanat alatt elkapod a feléd dobott tárgyat. Két példa, ahol az intuíció szinte "átlépi" a bonyolult matematikát:

1. Az "Elfogási stratégia" esetén amikor egy kutya el akar kapni egy repülő frízbit, nem számol röppályát. Egy egyszerű intuitív szabályt követ: tartja állandóan a látószöget. Ha a kutya úgy mozog, hogy a frízbi a látóterében mindig ugyanabban a szögben marad, akkor biztosan összeütköznek (azaz elkapja). A neve optikai lineáris célzásnak. Itt az intuíció egy bonyolult differenciálegyenlet-rendszert helyettesít egyetlen vizuális szabállyal.

2. A folyadékok viselkedése (Öntés és egyensúly) Ha valaki megpróbál teát önteni egy csészébe sötétben, csak a hang alapján, akkor az intuíciód pontosan tudja, hogyan változik a hangmagasság, ahogy telik a pohár. És tudni lehet, hogy mekkora erővel kell dönteni a kancsót, hogy a sugár ne csurogjon mellé.

Fizikai magyarázathoz ismerni kellene a viszkozitást, a felületi feszültséget és a hidrosztatikai nyomást. Az ember "érzi", mikor kell megállni, a korábbi tapasztalatai alapján.

2. A folyadékok viselkedése (Öntés és egyensúly) Ha valaki megpróbál teát önteni egy csészébe sötétben, csak a hang alapján, akkor az intuíciód pontosan tudja, hogyan változik a hangmagasság, ahogy telik a pohár. És tudni lehet, hogy mekkora erővel kell dönteni a kancsót, hogy a sugár ne csurogjon mellé.

Fizikai magyarázathoz ismerni kellene a viszkozitást, a felületi feszültséget és a hidrosztatikai nyomást. Az ember "érzi", mikor kell megállni, a korábbi tapasztalatai alapján.

A fizikusok mielőtt leírnának egy egyenletet, megtippelik az eredmény nagyságrendjét. Ha a számítás ettől nagyon eltér, tudják, hogy hiba van a matekban. Vagy a szimmetriaérzék, az intuíció súgja meg, hogy a természet szereti az egyensúlyt és az egyszerűséget.

A tudományos fizika megmondja, pontosan miért és mennyivel történik valami. Az intuitív fizika pedig megmondja, hogy mire számítsunk a következő másodpercben, hogy ne ütközzünk neki a falnak. A robotika és az AI számára az intuitív fizika a „Szent Grál”, mert a hagyományos programozás gyakran csődöt mond. Ha egy robotnak minden egyes mozdulat előtt le kellene futtatnia egy teljes fizikai szimulációt (súrlódás, tömegközéppont, légnyomás), mire megmozdulna, a labda már rég leesett volna.

Ezért próbálják az AI-t „ösztönössé” tenni:

1. Tanulás tapasztalati úton (Deep Reinforcement Learning)

Ahelyett, hogy beleprogramoznák Newton törvényeit, a robotot „játszani” hagyják. Egy robotkar több ezerszer próbál meg megfogni egy poharat. Az MI nem a képleteket tanulja meg, hanem mintázatokat ismer fel.

2. Videóból jósolni (Visual Foresight)

A kutatók (például a Google DeepMind vagy az OpenAI) olyan neurális hálókat tanítanak, amelyek videókat néznek. Pl. az MI-nek meg kell tippelnie, mi lesz a következő képkocka. Ha lát egy asztal szélén álló poharat, a „belső modellje” megjósolja, hogy ha meglökik, az le fog esni.

Amihez nem kell tudnia a gravitációs állandót, elég, ha „érzi” az oksági viszonyt, éa amit vizuális dinamikának neveznek.

3. A „fizikai szimulátor”

Néhány modern AI-rendszerbe beépítenek egy leegyszerűsített fizikai szimulátort (hasonlót, mint ami a videojátékokban van). Amikor a robot lát egy ismeretlen tárgyat, lefuttat egy gyors, „piszkozat-szintű” szimulációt a fejében. Nem a pontos tizedesjegyek érdeklik, csak az, hogy „felborul-e vagy sem”, és ez a digitális megfelelője az emberi „tippelésnek”, becslésnek.