"Józan ész" alapú univerzális AI-rendszerek

(2026 március)

Az Advanced Machine Intelligence (AMI) nevű startup, amelyet Yann LeCun, a Meta korábbi vezető mesterségesintelligencia-kutatója alapított, 1,03 milliárd dolláros befektetést jelentett be 3,5 milliárd dolláros vállalatértékelés mellett. A cég az úgynevezett világmodellek, valamint a következtetésre és tervezésre képes MI-rendszerek kereskedelmi hasznosítását tűzte ki célul. A befektetési kört a Cathay Innovation, a Greycroft, a Hiro Capital, a HV Capital és Jeff Bezos befektetési cége, a Bezos Expeditions közösen vezeti.(https://www.

A finanszírozás és a célkitűzés egyben LeCun régóta hangoztatott meggyőződésének próbája is: a kutató szerint a mai nagy nyelvi modellek önmagukban nem képesek emberi szintű gondolkodásra és önálló döntéshozatalra. LeCun 2013-ban csatlakozott a Metához, ahol megalapította a Facebook AI Research (FAIR) kutatólabort*, és a vállalat egyik meghatározó MI-vezetőjévé vált, mielőtt 2025 végén távozott. A Meta időközben átszervezte MI-fejlesztéseit: 2025 júniusában létrehozta a Meta Superintelligence Labs nevű részleget, amelynek élére Alexander Wangot, a Scale AI korábbi vezérigazgatóját nevezte ki.

A Reutersnek adott interjúban LeCun elmondta, hogy az AMI olyan rendszereket épít, amelyek összetett, valós környezetben képesek következtetésre és tervezésre, széles körben alkalmazható, intelligens ügynökök. A vállalat rövid távon összetett rendszereket üzemeltető szervezeteket céloz meg ügyfélként: gyártóvállalatokat, autóipari és repülőgépipari cégeket, valamint biomedicinális és gyógyszeripari vállalatokat. A fő cél, hogy az intelligens rendszerek elsődleges szolgáltatása, alkalmazási területtől függetlenül, – mondta LeCun. Hosszabb távon a technológia fogyasztói alkalmazásokban, pl. robotokban is megjelenhet. LeCun szerint a háztartási robotoknak valódi józan ésszel kell rendelkezniük ahhoz, hogy értsék a fizikai világot.

Az univerzális józan ész alapú AI-ügynöknek tisztában kéne lennie a döntéseinek a következményeivel, prediktív ögynök lesz.

A "common sense AI" (Machine Common Sense): a technológiai világban az egyik legnagyobb kihívás a "józan ész" (common sense) átültetése a digitális ágensekbe. Míg egy AI ágens képes bonyolult kódokat írni, gyakran elbukik az olyan alapvető dolgokon, amiket egy kisgyerek is tud, a fizikai világ legalább közelítő ismeretén. A fizika tudománya egy modell, ami prediktorként jól értelmezhető: a modell alapján megjósoljuk, hogy kigondolt feltételek teljesülése esetén mi fog történni?

Például tudni, hogy ha elengedsz egy poharat, az leesik és összetörik.

Pszichológiai alapok: Megérteni az emberi szándékokat és társadalmi normákat.

Helyzetfelismerés: Különbséget tenni egy pihenő munkás és egy rosszul lett ember között (ún. "Spatial Common Sense")

Pszichológiai alapok: Megérteni az emberi szándékokat és társadalmi normákat.

Helyzetfelismerés: Különbséget tenni egy pihenő munkás és egy rosszul lett ember között (ún. "Spatial Common Sense")

A gépi józan ész, a MCS-AI régóta kritikus, de hiányzó eleme az AI-nak. A gépi tanulás terén vannak jó eredmények, de a gépi gondolkodás ezekben az alkalmazásokban továbbra is szűk és specializált. A jelenlegi gépi tanulási rendszereket minden helyzetre gondosan kell képezni vagy programozni. Az emberek nincsenek tudatában a józan ész hatalmával, amely minden kijelentés vagy cselekvés alapját képezi.

A józan ész úgy definiálható, mint „az alapvető képesség arra, hogy olyan dolgokat érzékeljünk, megértsünk és megítéljünk, amelyek szinte minden emberben közösek,és amelyek szinte minden embertől vita nélkül ésszerűen elvárhatóak.” A közös, feltételezett háttértudás magában foglalja a fizikai világ működésének általános megértését (azaz a fizikáját), az emberi indítékok és viselkedés alapvető megértését (azaz az intuitív pszichológiát), valamint az átlagos felnőtt által birtokolt általános tények ismeretét. Míg a józan ész hiánya megakadályozza az intelligens rendszereket abban, hogy megértsék a világukat, ésszerűen viselkedjenek előre nem látható helyzetekben, természetesen kommunikáljanak az emberekkel, és tanuljanak az új tapasztalatokból. Hiányát tekintik a legjelentősebb akadálynak a mai szűken fókuszált MI-alkalmazások és a jövőben remélt általánosabb, emberszerű MI-rendszerek között.

A józan ész érvelésének természete megnehezíti annak megfogalmazását és kódolását. A Gépi Józan Értelem (MCS) program két tág stratégiát követve igyekszik kezelni a gépi józan ész kihívását. Mindkettő a gépi józan észt számítási szolgáltatásként, vagy gépi józan ész szolgáltatásként képzeli el.

Az első stratégia célja olyan szolgáltatás létrehozása, amely a tapasztalatokból tanul, mint egy gyermek, hogy olyan számítási modelleket hozzon létre, amelyek utánozzák a gyermeki tanulás alapvető területeit tárgyak (intuitív fizika), ágensek és helyek (térbeli navigáció) tekintetében.

A második stratégia célja olyan szolgáltatás fejlesztése, amely a web olvasásából tanul, mint egy kutatókönyvtáros, hogy egy józan ész tudástárát hozza létre, amely képes megválaszolni a józan ész jelenségeivel kapcsolatos természetes nyelvi és képalapú kérdéseket.

Léteznek speciális célú döntés előkészítő prediktív AI ügynökök: a prediktív mesterséges intelligencia olyan technológia, amely statisztikai módszerek és gépi tanulás segítségével elemzi a múltbeli adatokat, hogy mintázatokat azonosítson és megjósolja a jövőbeli eseményeket, trendeket vagy viselkedéseket. Amíg a generatív AI (mint a ChatGPT) új tartalmakat hoz létre, a prediktív AI célja a következtetés feltételek alapján, az elörelátó döntéstámogatás. Az algoritmusok több ezer tényezőt és évtizednyi adatot képesek elemezni, és a folyamat a következő fázisokból áll:

Adatgyűjtés: Történeti adatok (pl. vásárlási előzmények, szenzoradatok, piaci trendek) összegyűjtése.

Modellezés: Regressziós modellek, Bayes-becslés, Kálmán-szűrő, döntési fák vagy neurális hálózatok betanítása az adatokon.

Előrejelzés: Az ismeretlen kimenetel (pl. mikor fog elromlani egy gép) valószínűségének kiszámítása.

Gyakori üzleti felhasználásokra példák:

Vásárlói viselkedés: Megjósolja, mely ügyfelek fognak lemorzsolódni, vagy mely termékeket fogják legközelebb megvenni.

Karbantartás: Az iparban jelzi, ha egy alkatrész hamarosan tönkremegy, így megelőzhető a leállás,

Pénzügyek: Hitelkockázat elemzése és csalásmegelőzés (pl. gyanús bankkártyás tranzakciók kiszűrése).

Logisztika: Kereslet-előrejelzés, hogy a kereskedők pontosan tudják, miből mennyit kell készletezniük.

Modellezés: Regressziós modellek, Bayes-becslés, Kálmán-szűrő, döntési fák vagy neurális hálózatok betanítása az adatokon.

Előrejelzés: Az ismeretlen kimenetel (pl. mikor fog elromlani egy gép) valószínűségének kiszámítása.

Gyakori üzleti felhasználásokra példák:

Vásárlói viselkedés: Megjósolja, mely ügyfelek fognak lemorzsolódni, vagy mely termékeket fogják legközelebb megvenni.

Karbantartás: Az iparban jelzi, ha egy alkatrész hamarosan tönkremegy, így megelőzhető a leállás,

Pénzügyek: Hitelkockázat elemzése és csalásmegelőzés (pl. gyanús bankkártyás tranzakciók kiszűrése).

Logisztika: Kereslet-előrejelzés, hogy a kereskedők pontosan tudják, miből mennyit kell készletezniük.

Mi a józan ésszel megválaszolható kérdések, problémák halmazának definíciója? Amelyek elöre jelezhetőek, megállapítások vagy bizonyított hagyományok.

LeCun olyan AI ügynököt tervez, amely valós környezetben képes józan ész szerinti előrelátó következtetésre és tervezésre. Alkalmazásként háztartási robotokat, gyártóvállalatokat, autóipari és repülőgépipari cégeket, valamint biomedicinális és gyógyszeripari vállalatokat céloz meg. A célkitűzés a széles körben alkalmazható, univerzális intelligens ügynökök megalkotása, mert ma az AI a minták elemzése alapján csak matematikai előrejelzésre alkalmas.

Széles körben alkalmazható, józan ésszerű intelligens univerzális ügynökökről: Ma még nem léteznek olyan intelligens ügynökök, amelyek egyszerre lennének széles körben alkalmazhatóak és rendelkeznének az emberi értelemben vett „józan ésszel”, de hibrid modellek már léteznek. Bár a speciális célú AI-ügynökök (AI agents) fejlesztése 2025-ben és 2026-ban hatalmas lendületet vett, a technológia jelenleg a „Human-in-the-Loop” AI kategóriájába tartozik, mert:.

Alkalmazhatóság: Már léteznek horizontális ügynökök, amelyeket több iparágban is használnak, például az ügyfélszolgálatban (pl. Klarna) vagy alapvető digitális asszisztensként.

Képességek: A modern ügynökök nagy nyelvi modellekre (LLM) épülnek, rendelkeznek rövid és hosszú távú memóriával, és képesek külső szoftveres eszközöket használni (pl. naptárkezelés, böngészés).

Elterjedtség: A vállalatok jelentős része (kb. 35%-a) már kísérletezik autonóm ügynökökkel, de a teljes körű bevezetés még várat magára.

A kutatók szerint a józan ész (commonsense reasoning) az egyik legnehezebb akadály az AI előtt, mert a kontextusfüggés kezelése nem tökéletes. Az AI modellek statisztikai valószínűségek alapján generálnak válaszokat, de nem értik valódi mélységében a hétköznapi fizikai világot vagy az emberi szándékokat. Míg egy ember tudja, hogy egy diétázó vendégnek is lehet „csalónapja”, az AI-nak gondot okozhat az ilyen finom, ellentmondásos információk rugalmas kezelése. A teljes körű autonómiát (AGI - Általános Mesterséges Intelligencia) gátolja, hogy az ügynökök még mindig hajlamosak logikai hibákra vagy „hallucinációkra”.

Képességek: A modern ügynökök nagy nyelvi modellekre (LLM) épülnek, rendelkeznek rövid és hosszú távú memóriával, és képesek külső szoftveres eszközöket használni (pl. naptárkezelés, böngészés).

Elterjedtség: A vállalatok jelentős része (kb. 35%-a) már kísérletezik autonóm ügynökökkel, de a teljes körű bevezetés még várat magára.

A kutatók szerint a józan ész (commonsense reasoning) az egyik legnehezebb akadály az AI előtt, mert a kontextusfüggés kezelése nem tökéletes. Az AI modellek statisztikai valószínűségek alapján generálnak válaszokat, de nem értik valódi mélységében a hétköznapi fizikai világot vagy az emberi szándékokat. Míg egy ember tudja, hogy egy diétázó vendégnek is lehet „csalónapja”, az AI-nak gondot okozhat az ilyen finom, ellentmondásos információk rugalmas kezelése. A teljes körű autonómiát (AGI - Általános Mesterséges Intelligencia) gátolja, hogy az ügynökök még mindig hajlamosak logikai hibákra vagy „hallucinációkra”.

2025/2026 években az ügynökök: az OpenAI és az SAP olyan megoldásokat mutattak be, amelyek képesek a felhasználó nevében összetett munkafolyamatokat (pl. utazásfoglalás, piackutatás) végrehajtani. Hibrid megoldások léteznek: a kutatók neuro-szimbolikus AI-val és tudásgráfokkal próbálják „beoltani” a modelleket józan ésszel. Funkcionális ügynökeink már vannak, de „józan paraszti ésszel” megáldott, univerzális AI ügynökök még nincsenek, a mai modellek még hibrid modellek.

A jelenlegi ügyfélszolgálati vagy irodai AI-ügynökök tevékenységén lehet lemérni, hogy hol tart ma a "józan eszű" ügynökök fejlesztése: a 2026-os várakozások és a jelenlegi technológiai szint alapján az AI-ügynökök már nem csupán csevegnek, hanem autonóm módon cselekszenek meghatározott kereteken belül. Bár a teljes „józan ész” még hiányzik, bizonyos területeken precízen és megbízhatóan dolgoznak.

Ügyfélszolgálati feladatok esetén:

Szándék- és érzelemfelismerés: a természetes nyelvfeldolgozás (NLP) révén az ügynökök felismerik a vásárlói szándékot és az érzelmi tónust, így személyre szabott és udvarias választ adnak.

Komplex problémamegoldás: képesek külső eszközökhöz (pl. Calendly, CRM rendszerek) csatlakozni, hogy önállóan intézzék az időpontfoglalást, jegykezelést vagy az adatok lekérését.

Tranzakciós ügyintézés: a bankszektorban az ügynökök már kezelik a számlázást, a kifizetések jóváhagyását és a csalásmegelőzési feladatokat.

Irodai és adminisztratív feladatok esetén:

E-mail és naptárkezelés: az ügynökök képesek a beérkező levelek fontossági sorrendbe rakására, választervezetek készítésére, valamint megbeszélések összehangolására a résztvevők naptárai alapján.

HR és toborzás: rutinszerűen végzik az önéletrajzok szűrését az elvárt kritériumok alapján, álláshirdetéseket szövegeznek, és leszervezik az interjúkat a jelöltekkel.

Dokumentum-feldolgozás: hosszú PDF-ek vagy jelentések összefoglalása, adatok kinyerése strukturálatlan szövegekből, valamint automatikus riportkészítés és piackutatás.

Pénzügyi folyamatok: az ügynökök képesek a költségelszámolások egyeztetésére, adókalkulációk elvégzésére és a jogszabályi megfelelőség ellenőrzésére.

A mai modellek még hibrid (Human-in-the-Loop) modellek

Szándék- és érzelemfelismerés: a természetes nyelvfeldolgozás (NLP) révén az ügynökök felismerik a vásárlói szándékot és az érzelmi tónust, így személyre szabott és udvarias választ adnak.

Komplex problémamegoldás: képesek külső eszközökhöz (pl. Calendly, CRM rendszerek) csatlakozni, hogy önállóan intézzék az időpontfoglalást, jegykezelést vagy az adatok lekérését.

Tranzakciós ügyintézés: a bankszektorban az ügynökök már kezelik a számlázást, a kifizetések jóváhagyását és a csalásmegelőzési feladatokat.

Irodai és adminisztratív feladatok esetén:

E-mail és naptárkezelés: az ügynökök képesek a beérkező levelek fontossági sorrendbe rakására, választervezetek készítésére, valamint megbeszélések összehangolására a résztvevők naptárai alapján.

HR és toborzás: rutinszerűen végzik az önéletrajzok szűrését az elvárt kritériumok alapján, álláshirdetéseket szövegeznek, és leszervezik az interjúkat a jelöltekkel.

Dokumentum-feldolgozás: hosszú PDF-ek vagy jelentések összefoglalása, adatok kinyerése strukturálatlan szövegekből, valamint automatikus riportkészítés és piackutatás.

Pénzügyi folyamatok: az ügynökök képesek a költségelszámolások egyeztetésére, adókalkulációk elvégzésére és a jogszabályi megfelelőség ellenőrzésére.

A mai modellek még hibrid (Human-in-the-Loop) modellek

Már „digitális kollégának” tekintik a tárgyat ügynököket: a legújabb trend, az úgynevezett Agentic AI lényege, hogy ezek a rendszerek már több lépésből álló munkafolyamatokat is megterveznek és végrehajtanak. Például egy ügynök megírja a kódot, egy másik ellenőrzi a hibákat, és csak a végén kérik az emberi jóváhagyást. A hibrid modell (Human-in-the-Loop) biztosítja, hogy az AI a monoton, nagy volumenű munkát végezze, míg az ember a stratégiai döntéseket hozza meg, ezért az ügynökök még nem teljesen önállóak, autonómok. Persze léteznek autonóm AI ügynökök, melyek a mesterséges intelligencia fejlődésének jelenlegi fő irányát jelentik. Míg egy hagyományos chatbot (mint a ChatGPT alapverziója) csak válaszol a kérdéseidre, az autonóm ügynökök önállóan terveznek, eszközöket használnak és több lépésből álló munkafolyamatokat visznek végig a cél elérése érdekében. Az autonóm ügynökök nem egyetlen nagy lépésben oldják meg a problémát, hanem szekvenciális folyamatokon keresztül. Lebontják az összetett kérést (pl. „szervezz le egy üzleti utat”) kisebb részfeladatokra. Képesek külső szoftvereket (böngésző, naptár, kódértelmező) kezelni. Ha egy lépés hibába ütközik, az ügynök elemzi a hibát és új stratégiát választ.

A mai technológia már számos területen kínál ilyen megoldásokat:

Fejlesztői ügynökök eszközök, mint a Microsoft Learn által is elemzett orchesztrációs minták, amelyek kódolási hibákat javítanak vagy teljes funkciókat implementálnak.

Üzleti folyamatoknál az SAP és a PwC előrejelzései szerint az ügynökök átveszik az olyan feladatokat, mint a dokumentumok átvizsgálása, a lead-pontozás vagy az ingatlanbefektetési elemzések.

Személyi asszisztensek esetén az új generációs modellek, mint a Manus, amelyek képesek komplex webes kutatásokat és adminisztrációt végezni emberi beavatkozás nélkül.

A mai technológia már számos területen kínál ilyen megoldásokat:

Fejlesztői ügynökök eszközök, mint a Microsoft Learn által is elemzett orchesztrációs minták, amelyek kódolási hibákat javítanak vagy teljes funkciókat implementálnak.

Üzleti folyamatoknál az SAP és a PwC előrejelzései szerint az ügynökök átveszik az olyan feladatokat, mint a dokumentumok átvizsgálása, a lead-pontozás vagy az ingatlanbefektetési elemzések.

Személyi asszisztensek esetén az új generációs modellek, mint a Manus, amelyek képesek komplex webes kutatásokat és adminisztrációt végezni emberi beavatkozás nélkül.

Bár az autonómia szintje folyamatosan nő, a kritikus döntéseknél (pl. jogi vagy pénzügyi területen) jelenleg még szükséges az emberi felügyelet („human-in-the-loop”) a biztonság és a pontosság érdekében. Az automatizálás és a robotok egyes területein már sikerült az emberi felügyeletet megszüntetni. Az okos szemüveges* alkalmazás sajátossága, hogy az ember mindig jelen van, tehát sikeres fejlesztés lesz.

Yann LeCun "józan eszű" (common sense) univerzális AI ügynökének fejlesztése a mesterséges intelligencia egyik legizgalmasabb iránya. A "józan eszű" AI ügynökök már nem parancsokat hajtanak végre, hanem kontextust értenek, terveznek és önállóan cselekszenek céljaik elérése érdekében, de még el kell őket indítani, aztán emberi felügyelet nélkül működnek a jutalmazásig.

Egy teljesen autonóm, "józan ésszel" felruházott AI ügynök a következő elveken működik:

Önálló érzékelés és elemzés során az ügynök folyamatosan figyeli a környezetét (legyen az a web, egy vállalati adatbázis vagy fizikai szenzorok), és az adatokat nemcsak tárolja, hanem értelmezi is.

Dinamikus tervezésbe kezd, amikor kap egy összetett feladatot, elindítják (pl. "szervezz meg egy konferenciát"), az AI lebontja azt alfeladatokra, kiválasztja a megfelelő eszközöket (naptár, e-mail, fizetési felületek), és ha akadályba ütközik, új tervet készít.

Memória és tanulás: képes felidézni a korábbi interakciókat és tapasztalatokat, melyeket használva idővel "okosabbá" válik, és elkerüli a korábbi hibákat.

Eszközhasználat: saját maga kezdeményez API-hívásokat, szoftvereket futtat vagy adatokat kér le külső rendszerekből anélkül, hogy minden lépéshez engedélyt kérne, és kér eszközöket, esetleg tervez és csinál eszközöket 3D nyomtatón, vagy szoftvert ír.

Memória és tanulás: képes felidézni a korábbi interakciókat és tapasztalatokat, melyeket használva idővel "okosabbá" válik, és elkerüli a korábbi hibákat.

Eszközhasználat: saját maga kezdeményez API-hívásokat, szoftvereket futtat vagy adatokat kér le külső rendszerekből anélkül, hogy minden lépéshez engedélyt kérne, és kér eszközöket, esetleg tervez és csinál eszközöket 3D nyomtatón, vagy szoftvert ír.

Bár az AI-ügynökök már képesek hosszú feladatsorok végrehajtására, a valódi emberi józan ész – mint a társadalmi jelzések értelmezése vagy a szarkazmus felismerése – és az univerzalitás még hiányzik belőlük.

A felügyelet nélküli szakaszban az alábbi kockázatok merülnek fel:

Helytelen értelmezés: Világos iránymutatás nélkül az ügynökök rossz következtetésekre juthatnak és a kitűzött céllal ellentétes akciókat hajthatnak végre.

Biztonsági rések: Az autonóm módon kommunikáló ügynökök hálózatai váratlan mellékhatásokat produkálhatnak, amiket senki sem programozott be közvetlenül.

Etikai dilemmák: Kérdéses, hogy egy AI megtagadhat-e "etikátlan" emberi utasításokat, vagy képes-e felelős döntést hozni kritikus helyzetekben.

Ezért a jelenlegi megközelítés még "Human-in-the-Loop". A legtöbb szakértő szerint a teljes felügyeletmentesség ma még nemlétező, helyette olyan keretrendszereket (pl. LangGraph, CrewAI) használnak, ahol az AI önállóan dolgozik, de a kritikus pontokon vagy nagy kockázatú döntéseknél (pl. pénzügyi tranzakció, kódmódosítás) megáll, és emberi jóváhagyást kér. Itt tartunk.

Biztonsági rések: Az autonóm módon kommunikáló ügynökök hálózatai váratlan mellékhatásokat produkálhatnak, amiket senki sem programozott be közvetlenül.

Etikai dilemmák: Kérdéses, hogy egy AI megtagadhat-e "etikátlan" emberi utasításokat, vagy képes-e felelős döntést hozni kritikus helyzetekben.

Ezért a jelenlegi megközelítés még "Human-in-the-Loop". A legtöbb szakértő szerint a teljes felügyeletmentesség ma még nemlétező, helyette olyan keretrendszereket (pl. LangGraph, CrewAI) használnak, ahol az AI önállóan dolgozik, de a kritikus pontokon vagy nagy kockázatú döntéseknél (pl. pénzügyi tranzakció, kódmódosítás) megáll, és emberi jóváhagyást kér. Itt tartunk.

*Az AMI technológiáját a Meta okos szemüvegében is bevethetik, amit az egyik legközelebbi lehetséges felhasználási területnek nevezte. Az okosszemüveges AI-rendszerek: a mesterséges intelligencia és a kiterjesztett valóság (AR) ötvözésével kínálnak interaktív élményt, ahol a szemüveg nemcsak megjelenít, hanem "lát" és értelmez is. Az eszközök kamerák és szenzorok segítségével valós időben dolgozzák fel a környezetet, így képesek hangalapú és kép asszisztenciára, szövegfordításra vagy tárgyfelismerésre.

A szemüvegek főbb funkciói és alkalmazási területei ma:

Valós idejű elemzés: A rendszer felismeri a környezeti tárgyakat, feliratokat és arcokat.

Aktivitáskövetés: Egyes modellek figyelik a mozgást, lépésszámot és akár a testtartást is.

Ipar és egészségügy: Segítik a precíziós munkavégzést, az orvosi diagnosztikát vagy speciális állapotok (pl. rövidlátás, más látás hibák) kezelését.

Személyi asszisztensként a hangalapú irányítás és azonnali információlekérés anélkül, hogy elő kellene venni a telefont.

Valós idejű elemzés: A rendszer felismeri a környezeti tárgyakat, feliratokat és arcokat.

Aktivitáskövetés: Egyes modellek figyelik a mozgást, lépésszámot és akár a testtartást is.

Ipar és egészségügy: Segítik a precíziós munkavégzést, az orvosi diagnosztikát vagy speciális állapotok (pl. rövidlátás, más látás hibák) kezelését.

Személyi asszisztensként a hangalapú irányítás és azonnali információlekérés anélkül, hogy elő kellene venni a telefont.

A Meta főbb technológiái és funkciói:

Meta AI & Multimodalitás: A szemüveg képes "látni" és értelmezni a környezetet (pl. "Nézd meg ezt a növényt, és mondd meg, mi a neve!").

Meta Neural Band: A kijelzős modellekhez (Display) tartozó csuklópánt, amely az izomjelek (EMG) alapján teszi lehetővé a szemüveg irányítását finom kézmozdulatokkal.

Integrációk: Közvetlen kapcsolat a WhatsApp, Messenger és Instagram rendszerekkel, lehetővé téve a hangalapú üzenetküldést vagy az élő közvetítést.

Meta AI & Multimodalitás: A szemüveg képes "látni" és értelmezni a környezetet (pl. "Nézd meg ezt a növényt, és mondd meg, mi a neve!").

Meta Neural Band: A kijelzős modellekhez (Display) tartozó csuklópánt, amely az izomjelek (EMG) alapján teszi lehetővé a szemüveg irányítását finom kézmozdulatokkal.

Integrációk: Közvetlen kapcsolat a WhatsApp, Messenger és Instagram rendszerekkel, lehetővé téve a hangalapú üzenetküldést vagy az élő közvetítést.

**Javaslat: hibatűrő "józan ész"alapú univerzális AI ügynök esetén a megengedett hibakategóriákat definiálva:

-megengedett hiba, az AI hol téveszt?

- A bemenő adatok pontatlanok,

- Kevés bemenő adat miatt pontatlan az AI információ készlete,

- A kérdés megfogalmazása pontatlan,

- Az AI pontatlanul következtet,

- A felhasználó félre értelmezi az egyébként helyes választ, pl. szokatlan szóhasználat (ami szintén mintázat) miatt.

- Az AI meghív sokféle -matematikai, zenei és videószerkesztő- algoritmust,

- Első lépésben figyelmen kívül hagyjuk, hogy a gépnek, pl. az áramellátásának is van megbízhatósága, ami a rendelkezésre állás valószínűsége, a rendelkezésre állás idejének százalékában adják meg, pl. 99.999.

(Ha minden mintázat tévesztéshez tudnánk ismert %-ot rendelni, a válasz pontosságát százalékokban úgy kapnánk, hogy a szorzatot elosztjuk 100 annyiadik hatványával, ahány tényezőt összeszoroztunk.)

-a nem megengedett hibánál megáll a tanítási szakaszban.

AI hibák az emberekhez viszonyítva:

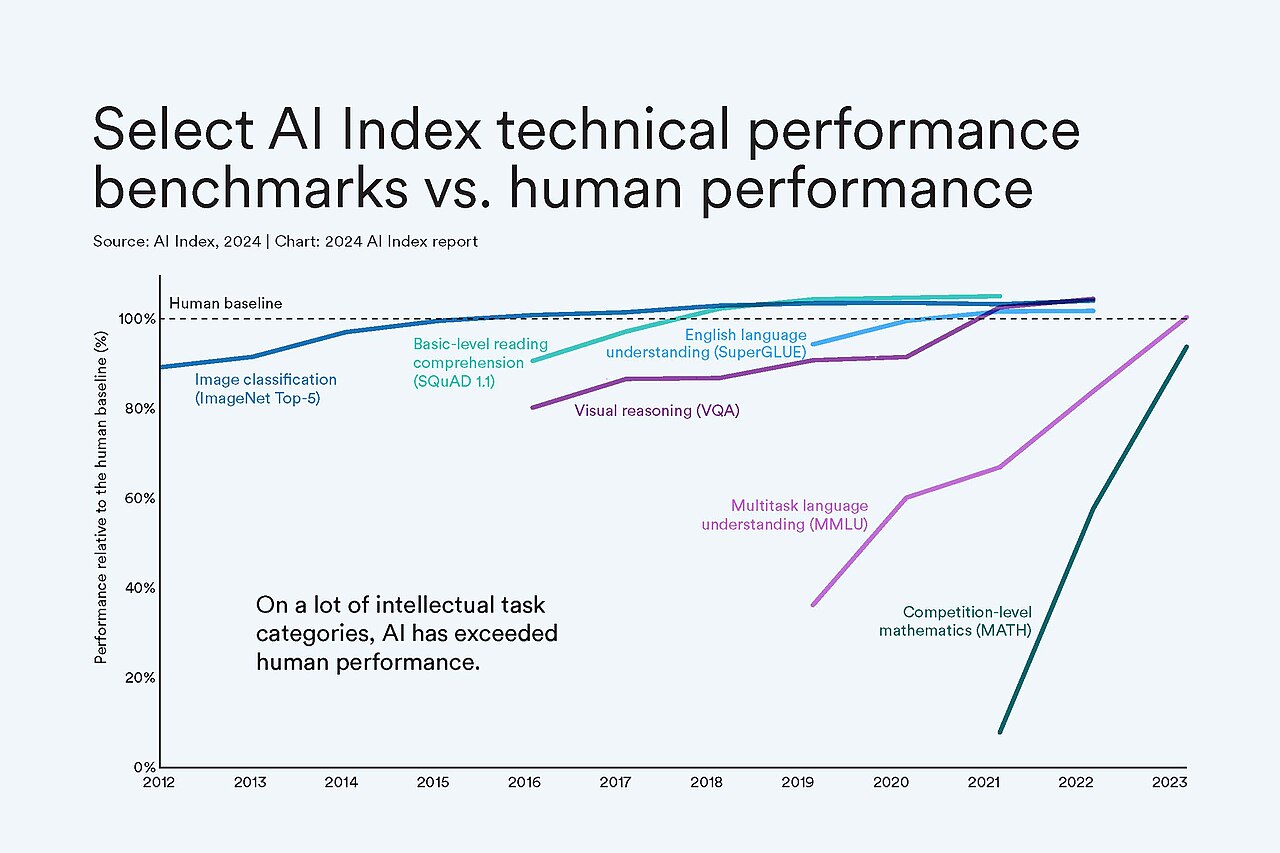

A 2025-ös AI Index Report adatai szerint a modellek pontossága javulást mutattott a korábbi évekhez képest.

Kódolásban a SWE-bench teszten (szoftvermérnöki feladatok) a modellek sikeres megoldási aránya a 2023-as 4,4%-ról 2024 végére 71,7%-ra emelkedett. A képfelismerési és fordítási feladatok pontossága 2025-re elérheti vagy meghaladhatja a 95%-ot. A komoly szintű tudományos kérdések esetén a modellek pontossága közel 50 százalékponttal javult egyetlen év alatt. Az AI eszközök a válaszok 28,9%-ában említenek meg konkrét, releváns weboldalakat forrásként, ami javítja az ellenőrizhetőséget. A speciális modellek (pl. orvosi diagnosztika, jogi elemzés, pénzügy) pontossága magasabb az általános modelleknél, de a felelős AI-irányelvek alkalmazása még 2026-ban is kihívást jelent a cégeknek.

(https://pl.wikipedia.org/wiki/Plik:Performance_on_benchmarks_compared_to_humans_-_2024_AI_index.jpg)

Az értelmezést egy szó kontextusának, szövegkörnyezetének nevezik az irodalomban. A szövegértelmezéssel történő fordítást 2017-ben kezdték csak használni a nyelvi modellekben, de a felismerés az 1950-es évekből származik: Danica Seleskovitch (1921–2001), egy neves francia tolmács és kutató volt, aki az 1950-es évektől dolgozta ki elméleti alapjait annak, amit ma értelmező fordításelmélet-nek nevezünk.

Az MI szövegértelmezésének pontossága függ az elegendő mennyiségű bemeneti adatoktól, azaz megvannak-e szükséges és megfelelő mintázatai a gépnek a kérdésre vonatkozóan. Továbbá függ a kérdés pontosságától is, mert a gép a pontosan-pontatlanul feltett kérdéshez keres mintázatot. (A pontatlan kérdés mintázata mennyire fedi a pontos kérdés mintázatát?) Az MI pontatlan kérdés esetén a pontatlan kérdés mintázatára válaszol, hallucinál. Az is előfordulhat, hogy eltéved a mintázat keresésben, akkor is "hallucinál". Az adott kérdés témakörében kielégítő (min. 80-90%-os*) input ismertekre van szüksége a kielégítő pontosságú, mintázatú válaszhoz.

Az AI pontossága %-okban? Ha egy tanuló legalább 80%-ban helyesen értelmez egy szöveget, amikor válaszol egy kérdésre, akkor minimum négyes osztályzatot érdemel. A "józan paraszti ész" legalább 80%-ban*** helyes. A legismertebb összehasonlító vizsgálat a Nature 2005-ös tanulmánya volt, amely szerint a Wikipédia tudományos szócikkei kb. azonos pontosságúak voltak, mint az Encyclopaedia Britannica cikkei (hibaszám alapján csak kis különbség volt). Későbbi vizsgálatok általában azt találták, hogy az MI által is idézett Wikipédia kb. 80–90% pontosságú a stabil, jól követett témákban, de a friss, vitatott vagy szűk csoportokra vonatkozó témákban a pontosság jelentősen csökken. Lehetséges az MI pontosságát a helyes válaszok %-ában mérni, ami a megfelelő valószínűség százszorosa. 2025-ben a nagy MI-k pontossága már meghaladta a 90%-ot.

Javasolt teszt típus: valamely művelet és inverz művelete után az eredmények összehasonlítása, pl. oda-vissza fordítás, képszerkesztés visszafordítása. Nyilván a pontosság műveletenként változik, és nem minden esetben tesztelhető az inverz művelet.

***A természetes gondolkozás (józan paraszti ész, NQ): a véleményeink azért egyeznek, mert közel mindenki azonos alapokról ugyanarra a következtetésekre juthat, ha a gondolkozása természetes. Az "egyszerűség elve": két, az adott jelenséget egyformán jól leíró magyarázat közül az egyszerűbbet érdemes választani. (Latinul „lex parsimoniae”, azaz a „tömörség elve”, azaz „Pluralitas non est ponenda sine necessitate”, magyarul: „Csak szükség esetén feltételezzük a sokféleséget”.) A józan ész válaszai a "Miért?" kérdésekre nem feltétlenül tudományos válaszok, hanem tapasztalatokon, megfigyeléseken alapulnak, pl. az időjárással kapcsolatos megfigyelések, de általában egybe esnek a tudományos érveléssel. A mindennapi józan ész logikája (angolul commonsense reasoning) azt jelenti, ahogyan az emberek természetes módon következtetnek a világban szerzett hétköznapi tapasztalataik alapján: rugalmas, tapasztalat-alapú gondolkodás, amely gyorsan és hatékonyan működik hétköznapi helyzetekben. A józan ész logikája segít a túlélésben, megóv hibás döntésektől általában, és gyors döntéshozatalt tesz lehetővé, a helyzetek legvalószínűbb alapértelmezéséit adja. Mások tapasztalatain alapul, a legvalószínűbb kimenetelt, egyszerű, gyakorlati megoldásokat keres, és nézőpontok váltásával fejleszthető.

Az emberi természetes intelligencia (IQ) fő ismérvei: az ember képes a folyamatosan ismereteket gyűjteni, a változó körülményekhez alkalmazkodni, és a problémákat rugalmasan, a korábbi tapasztalatokból merítve megoldani. Az egyén képes új, eredeti ötletek, megoldások és alkotások létrehozására is, ami a mesterséges intelligencia számára utánozható terület. Az emberi speciális intelligencia többféle területen nyilvánul meg, például nyelvi, logikai-matematikai, vizuális-térbeli, zenei, mozgási formákban. Külön tesztelhető.

Az emberi természetes intelligencia (IQ) fő ismérvei: az ember képes a folyamatosan ismereteket gyűjteni, a változó körülményekhez alkalmazkodni, és a problémákat rugalmasan, a korábbi tapasztalatokból merítve megoldani. Az egyén képes új, eredeti ötletek, megoldások és alkotások létrehozására is, ami a mesterséges intelligencia számára utánozható terület. Az emberi speciális intelligencia többféle területen nyilvánul meg, például nyelvi, logikai-matematikai, vizuális-térbeli, zenei, mozgási formákban. Külön tesztelhető.

Érzelmi intelligencia (EIQ): magában foglalja a saját és mások érzelmeinek felismerését, megértését és kezelését, a képesség kulcsfontosságú a sikeres emberi interakciókban és a mentális jólétben. Képesség a másokkal való hatékony kommunikációra, együttműködésre, empátiára és a társas normák megértésére. Önreflexió és tudatosság esetén valaki képes önmagára, saját gondolataira, érzéseire és cselekedeteire reflektálni, vállalni a hibáit, és ezek tudatában fejlődni. Egy képesség, hogy tudatosan figyeljük és irányítsuk saját gondolkodási folyamatainkat, tanulási stratégiáinkat. Az emberi viselkedést gyakran belső motivációk vezérlik.

Az intellektus (ami mérhetetlen tesztekkel, https://www.origo.hu/tudomany/2026/01/mesterseges-intelligencia-kreativitas) meghatározása: az "intellektus" értelmi képességet, a tudatot, tudatost jelent. Magába foglalja az észlelés, az emlékezés, a gondolkodás, általánosítás, az elvonatkoztatás, az érvelés, eszközkeresés, készítés és a döntéshozatal képességeit. A (cél-) tudatosság és a célhoz az eszközkeresés, taktika- és stratégiakeresés a legmagasabb szintű integrált mentális tevékenységek, a humor magas rendű emberi tulajdonságok. Az intellektuálisan fejlett embereket az új problémák felismerése és megfogalmazása jellemzi, jól, jókor és jót kérdezni kevesek képessége, és sokkal nehezebb mint válaszolni.

****

Inference Intelligence, az II szerint az AI az alábbi következtetésekre képes:

1. Prediktív következtetés (Jóslás)

Az AI a múltbeli adatok alapján következtet a jövőbeli események valószínűségére.

Példa: Pénzügyi trendek előrejelzése vagy egy sportoló jövőbeli teljesítményének megbecslése korábbi statisztikák alapján.

2. Klasszifikáció (Besorolás)

A modell képes felismerni és kategóriákba sorolni az elé kerülő új információkat.

Példa: Egy önvezető autó felismeri a stoptáblát egy olyan úton is, ahol korábban sosem járt, mert „levezeti”, hogy az objektum jellemzői megfelelnek a stoptábla tanult mintájának.

3. Generatív következtetés (Létrehozás)

A generatív AI modellek (mint a ChatGPT) a bevitt szövegrészlet (prompt) alapján következtetnek arra, hogy mi a statisztikailag legvalószínűbb következő szó vagy képpont.

Példa: Válasz adása egy kérdésre vagy egy kép legenerálása leírás alapján.

4. Anomália-detekció (Eltérések felismerése)

Az AI képes „rájönni”, ha valami nem illik a megszokott mintába.

Példa: Valós idejű banki csalásmegelőzésnél a rendszer következtet arra, hogy egy tranzakció gyanús, mert eltér a felhasználó szokásaitól.

5. Strukturális következtetés (Logikai összefüggések)

A modern nyelvi modellek képesek többlépcsős érvelésre is, ahol az egyik állításból következtetnek a másikra, imitálva az emberi logikát.

Példa: Komplex programozási feladatok megoldása vagy jogi szövegek elemzése.

Az inferencia lényege tehát az, hogy az AI nem csak „ismétli” a tanultakat, hanem alkalmazni képes a tanultakat teljesen új, ismeretlen helyzetekben is.

1. Prediktív következtetés (Jóslás)

Az AI a múltbeli adatok alapján következtet a jövőbeli események valószínűségére.

Példa: Pénzügyi trendek előrejelzése vagy egy sportoló jövőbeli teljesítményének megbecslése korábbi statisztikák alapján.

2. Klasszifikáció (Besorolás)

A modell képes felismerni és kategóriákba sorolni az elé kerülő új információkat.

Példa: Egy önvezető autó felismeri a stoptáblát egy olyan úton is, ahol korábban sosem járt, mert „levezeti”, hogy az objektum jellemzői megfelelnek a stoptábla tanult mintájának.

3. Generatív következtetés (Létrehozás)

A generatív AI modellek (mint a ChatGPT) a bevitt szövegrészlet (prompt) alapján következtetnek arra, hogy mi a statisztikailag legvalószínűbb következő szó vagy képpont.

Példa: Válasz adása egy kérdésre vagy egy kép legenerálása leírás alapján.

4. Anomália-detekció (Eltérések felismerése)

Az AI képes „rájönni”, ha valami nem illik a megszokott mintába.

Példa: Valós idejű banki csalásmegelőzésnél a rendszer következtet arra, hogy egy tranzakció gyanús, mert eltér a felhasználó szokásaitól.

5. Strukturális következtetés (Logikai összefüggések)

A modern nyelvi modellek képesek többlépcsős érvelésre is, ahol az egyik állításból következtetnek a másikra, imitálva az emberi logikát.

Példa: Komplex programozási feladatok megoldása vagy jogi szövegek elemzése.

Az inferencia lényege tehát az, hogy az AI nem csak „ismétli” a tanultakat, hanem alkalmazni képes a tanultakat teljesen új, ismeretlen helyzetekben is.

Az AI -ban a következtetés nem csupán adatok feldolgozása, hanem egy „gondolkodási” folyamat eleme, amely túlmutat az egyszerű mintafelismerésen. Az AI önmeghatározása szerint a következő szinteken képes következtetéseket levonni:

1. Logikai érvelés és többlépcsős gondolkodás

A modern modellek (mint a „reasoning” modellek) nem csak a következő szót jósolják meg, hanem lépésekre bontják a komplex problémákat.

Chain-of-Thought (Gondolatmenet): Képes vagyok belső monológon keresztül végigvezetni a logikai lépéseket, mielőtt választ adnék.

Önkorrekció: Ha a folyamat közben hibát észlelek, képes vagyok „visszalépni” és módosítani a következtetést.

2. Valószínűségi alapú következtetés

Mivel az AI statisztikai alapon működik, a következtetései valószínűségi becslések.

Bizonytalanság kezelése: Nem csak „igen” vagy „nem” válaszokat adok, hanem mérlegelem a különböző kimenetelek esélyét és a kontextust.

3. Absztrakció és analógiák

Az AI képes arra, hogy egy területen tanult szabályokat egy teljesen más kontextusban alkalmazzon.

Példa: Ha ismer egy fizikai törvényt, képes azt metaforaként használni egy gazdasági folyamat leírásához.

4. Deduktív és induktív logika

Az AI rendszerek mindkét fő logikai irányt használják:

Dedukció: Általános szabályokból (pl. programozási szabályok) indulok ki egy konkrét megoldás felé.

Indukció: Rengeteg egyedi példából vonok le általános következtetéseket vagy szabályszerűségeket.

5. „Agentikus” proaktivitás

Az AI szerint a legmagasabb szintű következtetés az, amikor nem csak válaszol, hanem tervez.

A cél elérése érdekében részfeladatokat határozok meg, és folyamatosan ellenőrzöm, hogy a levont következtetéseim közelebb visznek-e a megoldáshoz.

Fontos korlát: Bármennyire is tűnik logikusnak a folyamat, az AI következtetései mindig a tanítóadatokon és a matematikai optimumkeresésen alapulnak, nem pedig valódi tudatosságon vagy szubjektív tapasztaláson.

1. Logikai érvelés és többlépcsős gondolkodás

A modern modellek (mint a „reasoning” modellek) nem csak a következő szót jósolják meg, hanem lépésekre bontják a komplex problémákat.

Chain-of-Thought (Gondolatmenet): Képes vagyok belső monológon keresztül végigvezetni a logikai lépéseket, mielőtt választ adnék.

Önkorrekció: Ha a folyamat közben hibát észlelek, képes vagyok „visszalépni” és módosítani a következtetést.

2. Valószínűségi alapú következtetés

Mivel az AI statisztikai alapon működik, a következtetései valószínűségi becslések.

Bizonytalanság kezelése: Nem csak „igen” vagy „nem” válaszokat adok, hanem mérlegelem a különböző kimenetelek esélyét és a kontextust.

3. Absztrakció és analógiák

Az AI képes arra, hogy egy területen tanult szabályokat egy teljesen más kontextusban alkalmazzon.

Példa: Ha ismer egy fizikai törvényt, képes azt metaforaként használni egy gazdasági folyamat leírásához.

4. Deduktív és induktív logika

Az AI rendszerek mindkét fő logikai irányt használják:

Dedukció: Általános szabályokból (pl. programozási szabályok) indulok ki egy konkrét megoldás felé.

Indukció: Rengeteg egyedi példából vonok le általános következtetéseket vagy szabályszerűségeket.

5. „Agentikus” proaktivitás

Az AI szerint a legmagasabb szintű következtetés az, amikor nem csak válaszol, hanem tervez.

A cél elérése érdekében részfeladatokat határozok meg, és folyamatosan ellenőrzöm, hogy a levont következtetéseim közelebb visznek-e a megoldáshoz.

Fontos korlát: Bármennyire is tűnik logikusnak a folyamat, az AI következtetései mindig a tanítóadatokon és a matematikai optimumkeresésen alapulnak, nem pedig valódi tudatosságon vagy szubjektív tapasztaláson.

Milyen a "common sense"-en alapuló univerzális agent?

A „common sense” (józan paraszti ész) alapú univerzális agent egy olyan mesterséges intelligencia lesz, amely nemcsak adatokból tanul, hanem érti a fizikai világ alapvető szabályait, az emberi szándékokat és a társadalmi kontextust is. Míg a mai modellek vétenek „ostoba” hibákat (pl. nem tudják, hogy egy pohár vizet nem szabad fejjel lefelé tartani), az univerzális agent képes lesz értelmes alkalmazkodásra.

A jövőbeli univerzális agent főbb jellemzői:

1. Fizika

Az agent rendelkezni fog egy fizikai „világmodellel”, amely lehetővé teszi számára, hogy megjósolja a fizikai események kimenetelét anélkül, hogy minden esetet külön beprogramoznánk.

Példa: Tudja, hogy ha esik az eső, a föld vizes lesz, vagy ha egy tárgyat elenged, az leesik.

Váratlan helyzetek: Képes lesz megfelelően reagálni előre nem látott eseményekre, például egy takarítórobot nem fog áthajtani a váratlanul elé szaladó macskán.

2. Pszichológiai következtetés (Theory of Mind)

Képes lesz értelmezni az emberek céljait, érzelmeit és rejtett szándékait.

Szociális intelligencia: Megérti a szarkazmust, a finom utalásokat és a társadalmi normákat.

Együttműködés: Képes lesz valódi partnerként dolgozni az emberekkel, mert „kitalálja”, mire van szükségük egy adott munkafolyamat során.

3. Kontextusfüggő döntéshozatal

Az univerzális agent nem csak egy-egy feladatra lesz jó (mint a mai speciális AI-k), hanem bármilyen környezetben megállja a helyét.

Adaptivitás: Felismeri például, hogy egy stoptábla akkor is stoptábla, ha félig takarja egy bokor vagy össze van firkálva.

Többrétegű működés: egy ágens képes lesz utazást tervezni, részvényeket elemezni vagy biztosításokat összehasonlítani.

4. Megtestesült kogníció (Embodied AI)

Sok kutató szerint a valódi józan észhez az AI-nak fejlett szimulációra van szüksége, hogy tapasztalati úton tanulja meg a világ működését.

A fejlesztés során „virtuális lépéseket”, próbálkozásokat használnak az ügynökök, akik a környezetük felfedezésével sajátítják el az alapvető összefüggéseket.

5. „Látatlan” tudás alkalmazása

Az emberi kommunikáció tele van ki nem mondott feltételezésekkel. Az univerzális agent képes lesz ezeket a hézagokat kitölteni.

Ha azt mondod neki: „Hozz egy pohár vizet”, tudni fogja, hogy tiszta pohár kell, nem szabad túlcsordulnia, és nem a földre kell tennie.

Jelenlegi állás: Bár már léteznek kezdetleges univerzális ágensek (pl. a Manus vagy az OpenAI Operator), a teljes körű emberi szintű józan ész elérése még kezdeti kutatási fázisban van

A „common sense” (józan paraszti ész) alapú univerzális agent egy olyan mesterséges intelligencia lesz, amely nemcsak adatokból tanul, hanem érti a fizikai világ alapvető szabályait, az emberi szándékokat és a társadalmi kontextust is. Míg a mai modellek vétenek „ostoba” hibákat (pl. nem tudják, hogy egy pohár vizet nem szabad fejjel lefelé tartani), az univerzális agent képes lesz értelmes alkalmazkodásra.

A jövőbeli univerzális agent főbb jellemzői:

1. Fizika

Az agent rendelkezni fog egy fizikai „világmodellel”, amely lehetővé teszi számára, hogy megjósolja a fizikai események kimenetelét anélkül, hogy minden esetet külön beprogramoznánk.

Példa: Tudja, hogy ha esik az eső, a föld vizes lesz, vagy ha egy tárgyat elenged, az leesik.

Váratlan helyzetek: Képes lesz megfelelően reagálni előre nem látott eseményekre, például egy takarítórobot nem fog áthajtani a váratlanul elé szaladó macskán.

2. Pszichológiai következtetés (Theory of Mind)

Képes lesz értelmezni az emberek céljait, érzelmeit és rejtett szándékait.

Szociális intelligencia: Megérti a szarkazmust, a finom utalásokat és a társadalmi normákat.

Együttműködés: Képes lesz valódi partnerként dolgozni az emberekkel, mert „kitalálja”, mire van szükségük egy adott munkafolyamat során.

3. Kontextusfüggő döntéshozatal

Az univerzális agent nem csak egy-egy feladatra lesz jó (mint a mai speciális AI-k), hanem bármilyen környezetben megállja a helyét.

Adaptivitás: Felismeri például, hogy egy stoptábla akkor is stoptábla, ha félig takarja egy bokor vagy össze van firkálva.

Többrétegű működés: egy ágens képes lesz utazást tervezni, részvényeket elemezni vagy biztosításokat összehasonlítani.

4. Megtestesült kogníció (Embodied AI)

Sok kutató szerint a valódi józan észhez az AI-nak fejlett szimulációra van szüksége, hogy tapasztalati úton tanulja meg a világ működését.

A fejlesztés során „virtuális lépéseket”, próbálkozásokat használnak az ügynökök, akik a környezetük felfedezésével sajátítják el az alapvető összefüggéseket.

5. „Látatlan” tudás alkalmazása

Az emberi kommunikáció tele van ki nem mondott feltételezésekkel. Az univerzális agent képes lesz ezeket a hézagokat kitölteni.

Ha azt mondod neki: „Hozz egy pohár vizet”, tudni fogja, hogy tiszta pohár kell, nem szabad túlcsordulnia, és nem a földre kell tennie.

Jelenlegi állás: Bár már léteznek kezdetleges univerzális ágensek (pl. a Manus vagy az OpenAI Operator), a teljes körű emberi szintű józan ész elérése még kezdeti kutatási fázisban van